estrategIA #1

Newsletter sobre Inteligencia Artificial en la Política y el Gobierno de la Institución Educativa ALEPH

La industrialización de la desinformación: una nueva era en el horizonte

“Por favor, quédese. Usted ponga las imágenes, que yo pondré la guerra”, cuando se habla de desinformación casi siempre vienen inmediatamente a mi cabeza esas supuestas palabras (que muy posiblemente también son apócrifas) del telegrama del magnate de la prensa William Randolph Hearst (cuya figura tan magníficamente nos acercó Welles en “Ciudadano Kane”) a su ilustrador en la Habana, tras recibir la petición de dicho dibujante para regresar a Estados Unidos ya que en Cuba no ocurría nada realmente. Sin embargo, días después, como había aseverado el propio Hearst, Estados Unidos entró en la guerra en 1898.

Y es que, si bien la desinformación y la manipulación informativa (y su utilización política) son fenómenos habituales desde que el mundo es mundo, lo cierto es que la tecnología ha disparado el número de casos en las últimas décadas y especialmente en los últimos años con ejemplos tan relevantes como el de Cambridge Analytica, en particular por su trascendencia en la campaña de Trump en 2016, o el ocurrido en torno al Brexit. La cuestión es que con la popularización de las inteligencias artificiales generativas muy probablemente la desinformación se va a volver aún mucho más generalizada hasta el punto en que muy pronto no nos vamos a poder creer nada de lo que veamos o escuchemos salvo que lo hagamos en persona.

En su muy reciente libro “The Coming Wave”, que se publicará dentro de una semana en España, Mustafa Suleyman, fundador de DeepMind, el laboratorio de Inteligencia Artificial de Google, dedica un interesante capítulo a estas cuestiones y acuña un término que me ha parecido especialmente interesante, “la industrialización de la desinformación”.

Hasta ahora los casos de manipulación informativa de gran calidad requerían un trabajo profesional, herramientas avanzadas que no solían estar al alcance de cualquiera, o como en el caso de Hearst controlar un periódico de gran tirada y tener muy poco amor a la verdad. En la actualidad vemos como ya (o en los próximos meses o años) cualquier persona con una simple aplicación móvil va a poder realizar deepfakes que pasarán como perfectamente reales a los ojos de cualquier persona no especialista en la materia. Un experto alertaba, a raíz de un triste caso de difusión de desnudos falsos de menores sucedido hace unos días en España, del peligro de las “aplicaciones de botón gordo” que permiten a cualquiera casi sin ningún tipo de conocimiento realizar falsificaciones tremendamente dañinas para otras personas.

Muy probablemente en los próximos años veremos como incluso algunos candidatos a pequeñas alcaldías o sus asesores podrán generar, sin apenas conocimientos técnicos, declaraciones falsas de otros candidatos clonando sus voces , podrán crear noticias inventadas en falsas webs de prestigio replicadas con IA, o incluso videos falsos, pero completamente creíbles, que muestren a rivales realizando actos ilegales todo ello simplemente escribiendo unas cuantas líneas de texto porque son tecnologías que ya se encuentran al alcance de cualquiera de forma incipiente y que se generalizarán y perfeccionarán en los años venideros. Esto, unido a su difusión masiva y anónima a través de redes sociales, puede tener efectos terribles especialmente en la política local donde el escrutinio público es mucho menor.

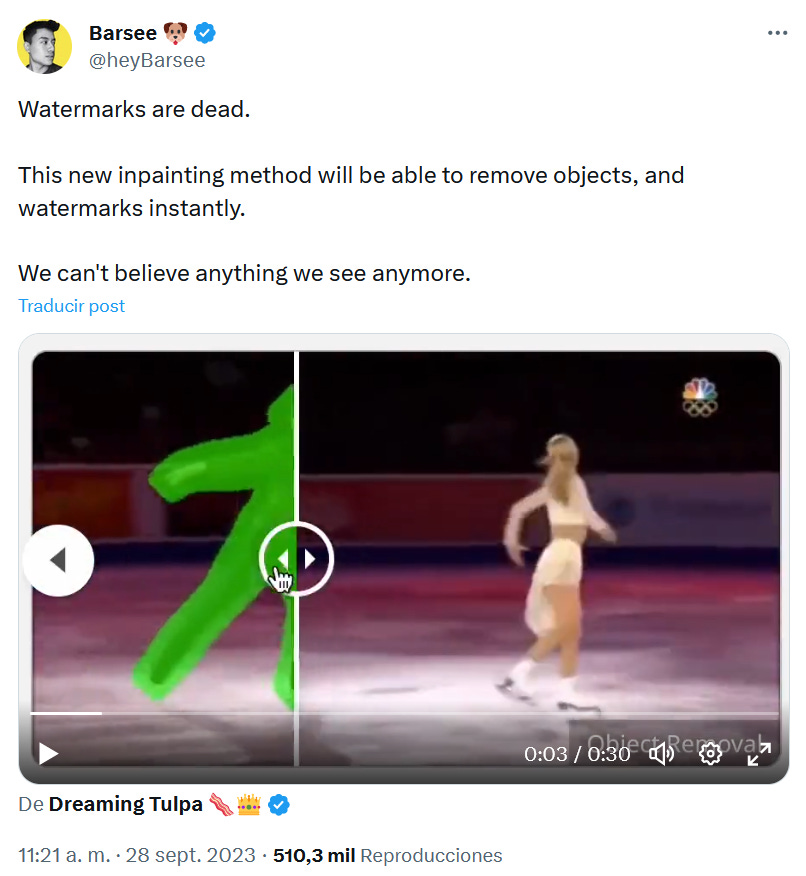

Esta última semana, por ejemplo, se presentaba una herramienta de inpainting en video con IA que quita directamente las marcas de agua de cualquier video –una de las medidas que utilizan, por ejemplo, algunos generadores de vídeo artificial de IA como forma de precaución– para marcar sus generaciones.

Ante esta cuestión algunas compañías como Google están intentando lograr sus propios sistemas para marcar obligatoriamente todo lo generado con Inteligencia Artificial, pero además de necesitar de una adopción global de estos sistemas, algo que no parece fácil, al igual que pasó con los textos generados con GPT-4, que la propia compañía admite que no existe ninguna forma fidedigna y confiable de diferenciarlos de uno que escriba cualquier humano, va ser muy complicado que simplemente utilizando la combinación de varias IAs y volviendo a manipularlas estas salvaguardas especiales no sean fácilmente superables. De hecho se aboga ya, ante lo difícil que puede ser lograr esa salvaguarda, por realizar el proceso contrario y marcar las imágenes y videos reales generados por las cámaras para así poder diferenciarlos de cualquier generación sintética.

Por tanto, parece claro que nos enfrentamos a un futuro muy complejo en cuanto a la desinformación política y que si bien las propias IAs se han utilizado y se utilizan (por ejemplo en muchas redes sociales) para detectar deepfakes y campañas de desinformación y luchar contra ellas sus nuevas capacidades generativas pueden traer en los próximos años un aluvión imparable de desinformación con un alto grado de “veracidad” a nuestros ojos humanos algo que, como indica Suleyman en su libro, hará que sea mucho más sencillo sembrar la inestabilidad:

* (texto original del libro en inglés traducido por GPT-4)

Cualquiera que esté motivado para sembrar inestabilidad ahora lo tiene más fácil. Supongamos que tres días antes de una elección, el presidente es capturado en cámara utilizando un insulto racista. La oficina de prensa de la campaña lo niega enérgicamente, pero todos saben lo que han visto. La indignación se propaga por todo el país. Las encuestas se desploman. Los estados indecisos de repente cambian hacia el oponente, que, contra toda expectativa, gana. Una nueva administración toma el cargo. Pero el video es un deepfake, uno tan sofisticado que elude incluso las mejores redes neuronales para detectar falsificaciones.

La amenaza aquí no reside tanto en casos extremos como en escenarios sutiles, matizados y altamente plausibles que se exageran y distorsionan. No es el presidente irrumpiendo en una escuela gritando tonterías mientras lanza granadas; es el presidente resignado diciendo que no tiene más remedio que instituir un conjunto de leyes de emergencia o reintroducir el reclutamiento. No son fuegos artificiales de Hollywood; es la supuesta grabación de la cámara de vigilancia de un grupo de policías blancos capturados en cinta golpeando a un hombre negro hasta matarlo.

Pero la amenaza se puede volver aún mucho más dañina en un futuro próximo cuando las IAs alcancen un paso más. En el libro Suleyman comenta los posibles daños que puede crear un terrorista radicalizado que pretenda captar adeptos para su organización a través de videos personalizados.

Pronto estos videos serán completamente interactivos y creíbles. Estarás hablando directamente con él. Él te conoce y se adapta a tu dialecto y estilo, juega con tu historia, tus agravios personales, el acoso escolar que sufriste, tus terribles e inmorales padres occidentalizados. Esto no es desinformación como un bombardeo masivo; es desinformación como un ataque quirúrgico.

Con todos estos peligros ya en el horizonte entramos muy probablemente en una nueva era para la desinformación política, quizá el único triste consuelo sea el que comenta en este video la editora jefe de The Economist, Zanny Minton-Beddoes, en la interesante conversación que mantiene con Yuval Noah Harari y el propio Mustafa Suleyman, “en los análisis que hemos realizado (desde The Economist) creemos que la IA puede tener menor impacto en el corto plazo en las elecciones y en el sistema político porque la confianza en los políticos ya está en mínimos”.

Fernando Nieto Lobato

Director de Innovación Digital de la Institución Educativa ALEPH

Actualidad y artículos de interés

Se trabaja en la creación de regulaciones para la IA en el seno de la ONU

Durante la reunión de esta semana de la Asamblea General de las Naciones Unidas en Nueva York, Amandeep Gill, el Enviado del Secretario General de la ONU en Tecnología, organizó un evento titulado "Gobernando la IA para la Humanidad". En este foro, los participantes discutieron los riesgos que la Inteligencia Artificial podría representar y los desafíos para lograr la cooperación internacional en este ámbito. En línea con estos esfuerzos, la ONU está trabajando en un marco de gobernanza global para la IA. Uno de los enfoques centrales es la posible creación de una nueva agencia especializada de la ONU para abordar las complejidades éticas y técnicas de la IA. Aunque se ha sugerido la posibilidad de una agencia al estilo de la Agencia Internacional de Energía Atómica, hay escepticismo sobre la viabilidad de tal entidad en el actual contexto de tensiones internacionales y falta de cooperación en el ámbito de tecnologías emergentes.

Inteligencia Artificial propia para la CIA

La CIA planea lanzar su propia versión de una herramienta de IA similar a ChatGPT para analizar grandes volúmenes de datos en la web en busca de pistas útiles y amenazas a la seguridad. Este programa ha sido desarrollado por la División de Empresas de Código Abierto de la CIA y se implementará en las 18 agencias de inteligencia del gobierno de EE. UU., con el objetivo de competir con las crecientes capacidades de inteligencia de China. Randy Nixon, director de la división de IA de la CIA, destacó la necesidad de adaptarse a la enorme cantidad de datos en la web y afirmó que el programa no tendrá limitaciones, salvo los costos asociados.

La Comisión Europea publica el primer Informe sobre el Estado de la Década Digital

El Informe contiene un breve apartado sobre Inteligencia Artificial que resalta que, con el Acta de IA que se está impulsando, la Unión Europea busca ser pionera en la regulación de amenazas potenciales planteadas por sistemas de IA y algoritmos, garantizando que se diseñen, desplieguen y utilicen respetando los derechos fundamentales y los valores democráticos. La Comisión propone clasificar algunos sistemas como de "alto riesgo" según su propósito e impacto, y estos tendrían que cumplir con requisitos específicos, como evitar la discriminación y permitir la supervisión humana. La transparencia también es un foco, con la obligación de etiquetar deepfakes e informar a las personas cuando interactúan con un sistema de IA. Adicionalmente, se han iniciado discusiones sobre un Pacto de IA, que busca el compromiso voluntario de la industria para implementar los requisitos principales del Acta antes de que se cumpla el plazo legal.

Vuelve al Congreso de Estados Unidos el proyecto de ley para regular la IA

El Congreso de Estados Unidos ha reintroducido el "Algorithmic Accountability Act of 2023", una legislación que busca regular los sistemas de Inteligencia Artificial (IA) generativos para proteger a los ciudadanos de daños potenciales. Este proyecto de ley, propuesto inicialmente en 2019, tiene como objetivo principal requerir que la Comisión Federal de Comercio (FTC) establezca reglas para que las empresas evalúen los sistemas impulsados por Inteligencia Artificial en términos de precisión, equidad, sesgo, discriminación, privacidad y seguridad. La legislación exige que las empresas realicen evaluaciones de impacto cuando usen IA para tomar decisiones críticas en áreas como vivienda, crédito y educación. Además, se crearía un repositorio público en la FTC para que los consumidores y defensores revisen cómo se han automatizado las decisiones críticas.

IA en acción (nuestro rincón más práctico)

Herramienta de IA de la semana

Dall-e 3, nueva versión del modelo pionero de IA para generar imágenes

Lo cierto es que estaba planificado hablar de otras herramientas en este número, pero las dejaremos para más adelante porque, por sorpresa, Microsoft abrió el pasado 30 de septiembre de forma gratuita a través de Bing la nueva versión de la que fue probablemente la primera herramienta clave —después vendría GPT— en la popularización de la IA en los últimos años: Dall-e.

Dall-e fue presentado al público el 5 de enero de 2021, pero fue el lanzamiento de Dall-e 2 con su llegada al público masivo a mediados del año pasado el que popularizó de forma decisiva el campo de las inteligencias artificiales generativas. Un año después, nos llega Dall-e 3, la última versión de Dall-e, que fue anunciada el 16 de agosto de 2023 y que tiene el doble de parámetros que Dall-e 2 (48 mil millones) y puede generar imágenes aún más complejas y creativas con prompts muy sencillos.

Enlace para utilizar el generador de imágenes con Dall-e 3 de Microsoft Bing, aunque también se pueden pedir directamente imágenes en el chatbot de BING

Algunos ejemplos:

Prompts para GPT-4

Si bien cada vez los nuevos modelos de IAs generativas comprenderán mejor nuestra forma de expresión habitual e interactuarán con gran calidad con un lenguaje natural, aún a día de hoy se logran mucho mejores resultados empleando buenos prompts detallados usando técnicas de lo que se conoce como prompt engineering. En esta sección queremos compartir con usted algunas posibles peticiones a la IA –en este caso están testados en GPT-4 pero su estructura probablemente también funcionará bien en otros asistentes– prompts que en ocasiones hemos utilizado para ampliar nuestro conocimiento incluso en campañas electorales reales y distintos proyectos (aunque, lógicamente, cambiaremos los datos de la petición por razones de privacidad y confidencialidad)

Generación de tweets para una campaña electoral.

Buenas, quiero que actúes como un gran consultor políticos experto en redes sociales. Genera cinco tweets para la campaña política de Pericles en Paraguay . El objetivo de la campaña es posicionarse como sólido candidato a la presidencia por sus grandes conocimientos de economía . Dirige el mensaje a jóvenes entre 20 y 30 años y resalta la propuesta o tema del empleo juvenil de calidad. Utiliza un tono directo y juvenil y asegúrate de incluir referencias a la cultura popular. Crea uno o varios hashtags específicos para la campaña.

Creación de un discurso de inauguración para un alcalde

Por favor, quiero que actúes como un gran logógrafo y consultor político. Crea un discurso para la inauguración de un centro de mayores, dirigido a los mayores del barrio de una ciudad española de unos 300.000 habitantes. El tema central es "las nuevas oportunidades que este centro les ofrece y el importante papel del Ayuntamiento apoyando a la tercera edad" y debe durar aproximadamente 10 minutos. Sigue una estructura clásica e incluye anécdotas y curiosidades muy conocidas por el público en general. Mantén un tono cercano

Si estrategIA te ha resultado interesante, nos ayudaría mucho que compartiera esta primera edición (tras el número cero de la semana pasada) con colegas y amigos interesados en el futuro de la IA, la política y el gobierno. Gracias.

Recomendación de la semana

Historia Visual sobre cómo funcionan las Inteligencia Artificiales generativas

El Financial Times realizó esta auténtica maravilla de la infografía interactiva para explicarnos cómo funcionan las Inteligencias Artificiales generativas gracias a los “transformers”:

Generative AI exists because of the transformer

En el Real o Fake de la semana pasada (la verdad es que era sencillo) acertaron el 75% de los que respondieron a la pequeña encuesta. La imagen real era la primera.

Meme de la semana

Hoy para concluir de forma más distendida la newsletter les traemos un meme relacionado con el tema principal de la semana, la desinformación, generado con el plugin “meme creator” de GPT-4. El prompt empleado ha sido simplemente el siguiente: “Quiero que actuando como un gran consultor político generes memes interesantes y divertidos para nuestra newsletter estrategIA . El tema de los memes debe ser la Inteligencia Artificial y la desinformación. ¿Necesitas alguna información adicional ?”