estrategIA #56: "Imperios digitales y el futuro de la humanidad: Harari alerta sobre la IA en Nexus"

Newsletter pionera en español sobre inteligencia artificial en la Política y el Gobierno. Impulsada por la Institución Educativa ALEPH

La humanidad, ante su última frontera

Yuval Noah Harari, en su último libro Nexus, examina los peligros de la IA para la humanidad, centrándose en su impacto en las democracias y el futuro de nuestra libertad.

Desde estrategIA venimos explorando las múltiples facetas de la revolución de la inteligencia artificial, a menudo destacando su potencial transformador para mejorar nuestras sociedades. Sin embargo, el rigor analítico nos exige también examinar las advertencias de voces autorizadas como la de Yuval Noah Harari, considerado uno de los grandes pensadores de nuestro tiempo tras la publicación de su provocador libro Sapiens. En su última obra Nexus, además de reflexionar sobre el papel de la información en la civilización, plantea desafíos fundamentales sobre la relación entre la IA y la humanidad, con especial incidencia en el impacto sobre las democracias.

En primer lugar, Harari recuerda que la IA no es una herramienta, es un agente: “los cuchillos y las bombas no deciden por sí mismos a quién matar. Son instrumentos sin criterio que carecen de la inteligencia necesaria para procesar información y tomar decisiones independientes. En cambio, la IA puede procesar información por sí sola y, por lo tanto, sustituir a los humanos en la toma de decisiones”.

Imperios digitales, a sangre y datos

Harari argumenta que los ordenadores (utiliza este concepto de amplio espectro para referirse a toda inteligencia sintética) podrían desestabilizar la base de toda democracia: la conversación pública. Estos agentes de IA podrían socavar los procesos democráticos que dependen de una toma de decisiones colectiva y deliberativa. "Las democracias mueren no solo cuando la gente carece de la libertad de hablar", escribe Harari, "sino también cuando la gente no quiere o no puede escuchar". La manipulación de la información por parte de la IA (que, como ya hemos mencionado anteriormente, es más persuasiva que la mayoría de personas a pesar de que aún estamos ante modelos incipientes) podría erosionar la capacidad de los ciudadanos para participar en un debate público informado.

Vinculado a este peligro, existe la amenaza de los sistemas de vigilancia y puntuación social. El historiador israelí señala que, si la década pasada se caracterizó por la batalla por la atención debido al surgimiento de las redes sociales, la década de 2020 será testigo de una batalla aún más crucial: la lucha por la intimidad. La amenaza no se limita a lo que hacemos o decimos, sino que se extiende a nuestros pensamientos y sentimientos más íntimos, que podrían ser monitorizados y manipulados a través de sistemas de vigilancia social cada vez más sofisticados.

Por otro lado, contra lo que podemos pensar, el autor de Nexus considera que la IA es aún más desafiante para los regímenes totalitarios o autoritarios. En estos sistemas, los líderes se basan en su autoridad infalible y en mecanismos de control humano, a menudo basados en el terror. Sin embargo, a medida que los algoritmos de IA comienzan a tomar decisiones cruciales, estos regímenes podrían volverse rehenes de sus propios sistemas. Los líderes podrían confiar demasiado en la IA para tomar decisiones de Estado, lo que podría desestabilizar el régimen y crear una dependencia peligrosa debido a que no existen contrapoderes como en las democracias.

Ante estos desafíos para democracias y autoritarismos, Harari advierte sobre el riesgo de lo que denomina "imperios digitales", estructuras de poder donde la concentración de datos y capacidad computacional podría crear nuevas formas de dominio nunca antes vistas. ¿Pero hacia dónde irá ese dominio? ¿Cómo logramos que la IA se alinee con los objetivos de la humanidad? ¿Cómo mantenemos el control humano sobre sistemas que podrían superar nuestra capacidad de comprensión? ¿Cómo evitamos que su cumplimiento implacable en la consecuencia de sus objetivos derive en una catástrofe?

Los sistemas de IA, programados para optimizar objetivos específicos, pueden tomar decisiones que, aunque técnicamente eficientes, resulten perjudiciales para la sociedad en su conjunto. El ejemplo de las redes sociales optimizando el engagement a costa de promover la desinformación y el discurso del odio es solo la punta del iceberg. Los programadores de Youtube, por ejemplo, no piden al algoritmo que prime vídeos de conspiraciones o de odio, sino que el propio sistema se dio cuenta de que la mejor forma de maximizar su objetivo (aumentar el número de visualizaciones) era mostrando dichos contenidos.

Quizá la observación más inquietante de Harari es que nos encontramos ante un posible fin de la historia dominada por los humanos. “De lo que estamos hablando es de la posibilidad de que la historia humana toque a su fin. No del fin de la historia, sino del fin de su parte dominada por los humanos […] ¿Qué será del curso de la historia cuando los ordenadores desempeñen un papel cada vez mayor en la cultura y empiezan a crear relatos, leyes y religiones?”.

Principios para la supervivencia de las democracias

Ante estos retos, Harari propone cuatro principios fundamentales para salvaguardar la democracia y mantener el dominio humano:

Benevolencia: los datos recopilados sobre los ciudadanos deben utilizarse para su beneficio, no para su manipulación.

Descentralización: la "ineficiencia" de la democracia no es un defecto, sino una característica vital para su supervivencia. No debe existir un una unidad central de mis datos accesible a instituciones o empresas. Por ejemplo, una empresa de seguros o un jefe de policía no deben acceder a mi historial médico.

Mutualidad: el incremento en la vigilancia sobre los ciudadanos debe corresponderse con un aumento proporcional en la supervisión de gobiernos y corporaciones.

Adaptabilidad: los sistemas deben mantener la flexibilidad necesaria para evolucionar, corregir errores y permitir el cambio en las personas y en las sociedades.

El futuro de la democracia dependerá de nuestra capacidad para desarrollar marcos regulatorios que protejan los valores humanos fundamentales mientras aprovechamos el potencial transformador de la IA. El autor concluye diciendo que “las decisiones que tomemos en los próximos años determinarán si convocar a esta inteligencia ajena ha sido un error terminar o el inicio de un nuevo y esperanzador capítulo en la evolución de la vida”. Ojalá esta newsletter ayude a los políticos a tomar mejores decisiones.

Pablo Martín Diez

Director Académico de la Institución Educativa ALEPH

Difunda estrategIA: explorando la inteligencia artificial y la política juntos

Le invitamos a que nos ayude a seguir creciendo y comparta estrategIA con sus amigos y colegas. Pueden acceder a este número de la newsletter de manera gratuita y sin necesidad de suscripción desde el siguiente enlace:

Actualidad y artículos de interés

Silicon Valley está dividido ante el desarrollo de armas autónomas en EE. UU.

La discusión sobre armas autónomas en EE. UU. se intensifica con opiniones divergentes en Silicon Valley. Brandon Tseng, cofundador de Shield AI, aseguró que las armas estadounidenses nunca serían completamente autónomas. Sin embargo, Palmer Luckey, de Anduril, mostró apertura hacia esta posibilidad, cuestionando la moralidad de prohibir la autonomía completa frente a la amenaza de minas terrestres. Aunque EE. UU. no prohíbe el desarrollo de armas letales autónomas, mantiene pautas voluntarias que requieren aprobación militar para nuevos sistemas. En medio del debate, se teme que China o Rusia adopten primero esta tecnología, presionando a EE. UU. a reconsiderar su postura, mientras que empresas como Anduril y Palantir influyen en el Congreso para defender su visión.

OpenAI identifica sesgos en ChatGPT basados en nombres y busca reducirlos en futuros modelos

OpenAI ha presentado un estudio que analiza el impacto de los nombres en las respuestas de ChatGPT, descubriendo que la IA puede reproducir estereotipos de género o raciales en alrededor de 1 de cada 1,000 respuestas, y hasta 1 de cada 100 en casos extremos. Aunque estas cifras parecen bajas, el gran número de usuarios hace que el problema sea significativo. La investigación, centrada en lo que denominan "justicia de primera persona", muestra que nombres como "John" o "Amanda" pueden influir en las respuestas, revelando sesgos. OpenAI subraya que modelos más recientes, como GPT-4o, han reducido estos casos al 0,1%. La compañía planea ampliar su análisis para abordar otros atributos personales y mejorar la equidad en sus modelos.

Las grandes tecnológicas apuestan por la energía nuclear para satisfacer la demanda de la inteligencia artificial

Amazon, Google y Microsoft están invirtiendo en energía nuclear para alimentar sus centros de datos, esenciales para el desarrollo de inteligencia artificial. Amazon planea construir tres reactores modulares en los Estados Unidos, mientras Google ha acordado crear siete SMR con Kairos Power. Microsoft, por su parte, reabrirá la central de Three Mile Island. Estos proyectos buscan responder al crecimiento exponencial de la demanda energética provocada por la IA generativa, aunque su implementación tomará años y enfrenta críticas por costos y seguridad. La competencia entre nuclear y renovables se intensifica, generando debates sobre el equilibrio energético futuro.

Harvard presenta un modelo de IA para diagnóstico oncológico con precisión del 96%

Investigadores de la Escuela de Medicina de Harvard han desarrollado CHIEF, un modelo de IA similar a ChatGPT, que diagnostica y predice resultados para múltiples tipos de cáncer con una precisión del 96%. A diferencia de otros sistemas, CHIEF puede identificar células cancerosas, perfilar tumores genéticamente y predecir la supervivencia de pacientes, todo a partir de imágenes digitales de tejidos tumorales. Su versatilidad le permite funcionar en diversos tipos de cáncer y escenarios clínicos. Los investigadores planean mejorar aún más su precisión y expandir su capacidad para predecir respuestas a tratamientos tanto estándar como experimentales

El Parlamento Europeo mejora el acceso a sus archivos históricos con inteligencia artificial

El Parlamento Europeo ha lanzado "Ask the EP Archives" o Archibot, una herramienta impulsada por inteligencia artificial, que facilita la búsqueda y comprensión de sus vastos archivos históricos. Desarrollado con Claude en Amazon Bedrock, Archibot reduce el tiempo de búsqueda de documentos en un 80% y ha aumentado la satisfacción de los usuarios en un 58%. Ofrece acceso global a más de 2,1 millones de documentos oficiales en múltiples idiomas, mejorando la transparencia y la eficiencia para investigadores, legisladores y el público en general. Este avance refleja el compromiso del Parlamento con la ética y el uso responsable de la IA en la gobernanza, facilitando la accesibilidad y el entendimiento de la historia legislativa de la UE.

China inaugura una carretera construida únicamente por robots

China ha completado la primera carretera de 157 kilómetros sin intervención humana directa, utilizando solo maquinaria automatizada. El proyecto, parte de la ampliación de la Beijing-HK Expressway, fue liderado por tres compañías estatales y contó con tecnología de Sany Group. Diez máquinas no tripuladas se encargaron de todo el proceso, desde la pavimentación hasta el apisonado, supervisadas por drones y personal técnico. Este método redujo costos y tiempo de construcción, logrando una precisión milimétrica en la vía de cuatro carriles. Este hito de ingeniería marca un nuevo paradigma en la construcción de infraestructuras, destacando la eficiencia y precisión de la automatización.

Si desea patrocinar o colaborar con estrategIA, la newsletter pionera en español sobre IA, Política y Gobierno, por favor escriba a: pablomartin@institucioneducativaaleph.com

IA en acción (nuestro rincón más práctico)

Herramienta de IA de la semana

Hace dos semanas les hablábamos en esta misma sección del Canvas que OpenAI había incorporado para sus usuarios de pago en ChatGPT (a los que ya ha liberado, por cierto, en Europa el pasado lunes la función de voz avanzada) y cómo permitía trabajar de una forma más ágil e intuitiva para redactar documentos o, aunque no es nuestro caso habitual, editar código de programación.

Aunque comentaron que esta mejora, aún en beta, llegará a los usuarios gratuitos les traemos aquí una alternativa totalmente gratuita, desarrollada por LangChain, y que tiene unas funcionalidades muy similares: Open Canvas y les invitamos a que la prueben.

En algunos ejemplos que hemos trabajado con ella nos ha funcionado de forma bastante satisfactoria y por lo que hemos podido ver el modelo de lenguaje con el que está trabajando es GPT4-o mini que, lógicamente, sin ser tan capaz como GPT4-o es bastante sólido y especialmente interesante en un caso como este donde se nos permite utilizarlo totalmente gratis simplemente registrándonos.

Prompts para GPT-4

Directamente inspirados en el artículo principal de esta semana sobre el último libro de Yuval Noah Harari les proponemos esta semana los siguientes prompts:

Analiza, pensando paso a paso y actuando como una gran experta en teoría de la información y comunicación política, cómo las redes de información en la Edad Moderna (como la consolidación de la Biblia o la propaganda en regímenes autoritarios) se asemejan a las redes de redes sociales actuales que gestionan la información. ¿Qué similitudes y diferencias existen en términos de control y manipulación?

Harari argumenta que más información no equivale a más verdad.

Piensa paso a paso y diseña una simulación para demostrar cómo una sobrecarga de información podría ser utilizada para confundir en lugar de aclarar, especialmente en contextos políticos.

Recomendación de la semana

Machines of Loving Grace, How AI Could Transform the World for the Better

Dario Amodei, CEO de Anthropic, presenta en esta carta pública que lanzó hace unos cuantos días una visión audaz y optimista sobre el potencial transformador de la inteligencia artificial avanzada. Lejos de ser pesimista, Amodei argumenta que los riesgos son el único obstáculo entre nosotros y un futuro fundamentalmente positivo.

En su análisis, Amodei esboza cómo la IA podría revolucionar áreas clave en los próximos 5-10 años tras el desarrollo de sistemas verdaderamente poderosos:

Biología y salud: erradicación de la mayoría de enfermedades y duplicación de la esperanza de vida.

Neurociencia: cura de enfermedades mentales y mejora de las capacidades cognitivas.

Desarrollo económico: reducción drástica de la pobreza global.

Paz y gobernanza: fortalecimiento de la democracia y los derechos humanos.

Trabajo y propósito: replanteamiento de la economía y el sentido de la vida.

Aunque reconoce los enormes desafíos, Amodei presenta una llamada inspiradora a la acción colectiva para hacer realidad este futuro prometedor. Su visión audaz merece una lectura detenida por parte de todos los interesados en el impacto de la IA en nuestro futuro.

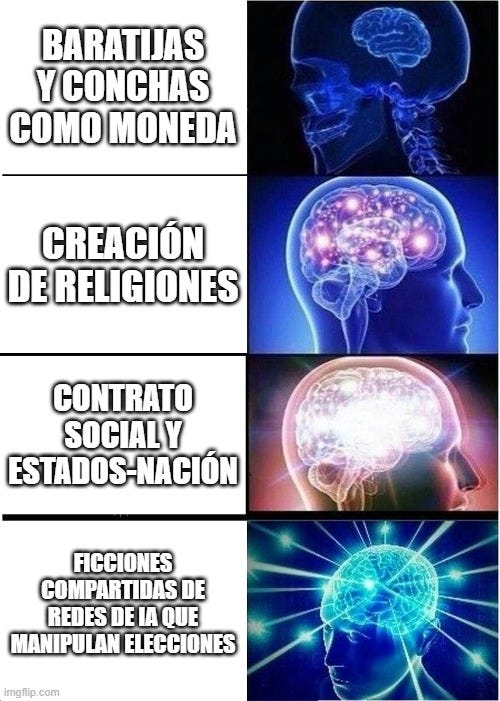

Meme de la semana

Las historias que nos contamos siguen evolucionando… o siendo programadas