estrategIA #63 - ¿Estamos preparados para una IA más inteligente que nosotros que ya está casi aquí?

Newsletter pionera en español sobre inteligencia artificial en la Política y el Gobierno. Impulsada por la Institución Educativa ALEPH

“No mires arriba”. La inteligencia artificial nos adelanta: ¿y nuestros gobiernos?

En estos primeros días de diciembre, hemos presenciado una enorme explosión en el desarrollo de la inteligencia artificial. Entre los anuncios más destacados se encuentra la presentación del modelo O1 y su versión O1 Pro (con más tiempo de computación y ligada a una suscripción mensual de 200 dólares), además de la presentación este pasado lunes de Sora y también un sistema con capacidades avanzadas de visión integrado en aplicaciones de voz, cuya demo fue presentada el pasado domingo en el programa “60 Minutos”. Todo ello por parte de OpenAI dentro de un modelo de lanzamiento de novedades en 12 días que recuerda los que hace años protagonizaba Apple en la época navideña.

Pero el resto de compañías también ha presentado cuestiones avanzadas muy interesantes en la última semana:

Google: Ha lanzado en su laboratorio abierto de IA la última versión previa de Gemini, un modelo que supera a GPT-4 en su última versión y que, según filtraciones, podría ser simplemente el modelo más pequeño de Gemini 2.

Grok de X.ai: Ahora es gratuito.

Aurora integrada en Grok: La IA de X.ai lanzó un nuevo modelo de imagen que permite un enorme grado de realismo. Aunque fue retirado rápidamente durante el fin de semana, el lunes volvió, sin nombre del modelo, directamente integrada en Grok.

Meta: Ha lanzado un modelo abierto de solo 70 mil millones de parámetros, igual de potente, pese a ser casi seis veces más pequeño, que su anterior modelo de 405 mil millones de parámetros que presentó hace sólo unos meses.

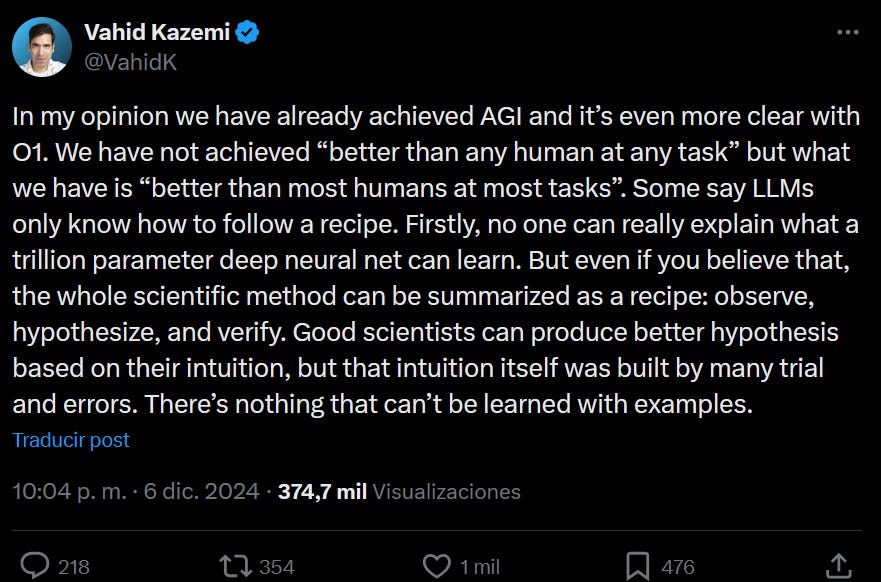

Estos avances no solo son importantes por sus capacidades actuales, sino, sobre todo, también porque indican un camino claro hacia la inteligencia artificial general, AGI por sus siglas en inglés, en los próximos años o incluso en los próximos meses. Según algunos investigadores de OpenAI, modelos como O1 Pro ya superan al humano promedio en una amplia gama de tareas.

Pero incluso si nos vamos a la definición más potente de la AGI, “mejor que cualquier humano en todas las tareas”, las revelaciones tecnológicas de esta semana pasada nos dice que no estamos demasiado lejos, y además desde los grandes laboratorios de IA se nos comunica que ya conocen el camino a transitar para llegar allí, porque el modelo O1, y más aún con su integración pro, es ya capaz de cosas como estas.

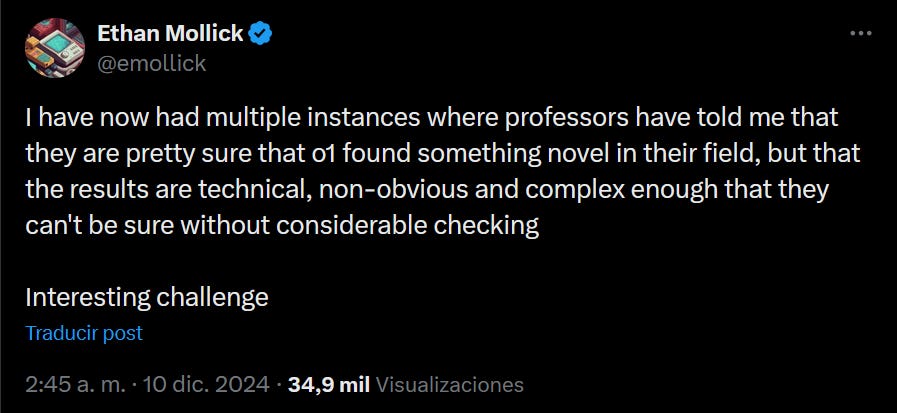

Hasta el punto de que necesitamos ya a los mejores expertos en cada campo para ser capaces de juzgar las verdaderas capacidades de este tipo de modelos de razonamiento, son “demasiado listos” para que encontremos tareas que puedan fácilmente desafiarlos y tienen sus principales usos en ciencia, matemáticas y tareas de alta complejidad que requieran razonamiento muy avanzado como señala en estos tweets el profesor de Wharton y experto en IA Ethan Mollick:

Hemos tenido la oportunidad de poder realizar ya unas cuantas pruebas con O1, aunque no en su sistema pro aún más potente –que se ofrece por 200 dólares mensuales y va dirigido a áreas muy concretas que puedan aprovechar al máximo su tiempo extra de computación–, y es realmente impresionante pero cuesta mucho encontrar casos de uso profesional “diario” en los que se aproveche realmente la verdadera potencia de este modelo. Incluso gracias a Carlos López Arístegui, vicerrector de Asuntos Académicos de ESIC, que nos ha cedido muy amablemente su último estudio de caso de negocio para que pudiéramos hacer pruebas con el modelo hemos visto que requiere de retos aún más complejos que lo pongan a “pensar”. Uno de nuestros propósitos para el 2025 es tratar de generar una pequeña base de casos especialmente complejos de política (idealmente sin datos preexistentes en Internet que puedan “trucar” el desempeño de los modelos –que no haya sido entrenado en sus respuestas o en lo que “pasó” después por ejemplo si hablamos de análisis electoral y ha habido unas elecciones posteriores con X resultado) para poder testar realmente si estos nuevos modelos son capaces de resultar diferenciales en el ámbito político y de gobierno –lo que es enormemente probable– pero sobre todo cómo podemos usarlos bien para cumplir incluso con esto que comenta Peter Welinder, uno de los altos ejecutivos de OpenAI: “Es estimulante –y tal vez un poco humillante– recibir instrucciones de un modelo que claramente es más inteligente que uno.”

En el campo de la política y el gobierno vamos a tener que plantearnos cómo tener datos valiosos y problemas complejos que nos permitan hacer preguntas realmente difíciles que se puedan realmente beneficiar de esta mayor inteligencia de los modelos de razonamiento.

Enlazando con esta reflexión sobre la política y el gobierno viene la cuestión clave, la IA está avanzando a pasos agigantados, empezamos a tener modelos más inteligentes que el humano promedio y que pronto van a poder ejecutar tareas como agentes (probablemente ahí veamos el siguiente gran salto de su adopción social) y mientras tanto qué hacen nuestros representantes ¿No miran para arriba?.

¿Y los políticos?

Tenemos ya modelos más inteligentes que los humanos en una gran cantidad de actividades, sabemos que mejoran a una velocidad difícil de creer, cada pocos meses vemos saltos importantes en su razonamiento y en sus capacidades e integraciones, conocemos que estos modelos ya permiten ser la base de agentes que no se limitarán a una interacción tipo chat sino que realizarán tareas complejas que puedan requerir varios pasos y usar diferentes herramientas ya el próximo año y la impresión que tiene uno cuando mira a la clase política de su entorno, y con escasísimas excepciones a toda la mundial –al menos al nivel público, queda siempre la esperanza de que haya una preparación privada mucho mayor de la que no nos dan noticias–, es que no se está haciendo casi nada.

En algunos países se han planteado algunas legislaciones mejorables bastante genéricas, que en algunos casos como en el de la Unión Europea están cargadas de buenas intenciones pero que plantean enormes problemas al desarrollo competitivo de la IA –de momento, por ejemplo, Sora sale ya en casi todos los países del mundo salvo en Reino Unido y la Unión Europea...-- y poco más, mientras las grandes corporaciones mundiales inyectan centenares de miles de millones de dólares en desarrollar los nuevos modelos de IA (y la inversión China es comparable en volumen) vemos a nuestros políticos enzarzados en sus batallas de poder de siempre preocupados por lograr o mantener el poder, por cuestiones identitarias o territoriales del siglo XIX o por los sempiternos casos de corrupción y ¿nadie mira hacia arriba? Ese meteorito que traerá pronto la explosión de la IA y que está ya a punto de impactar ¿No les dice nada?

Como sé que muchos políticos leen estas líneas cada semana, desde mi puesto de simple vigía avanzado de la evolución de la IA no me queda mucho más recurso que ser especialmente claro en una newsletter como la de hoy, subir al palo mayor de la nave y gritar “tierra, tierra” sin mucha esperanza de que se haga algo, pero al menos confío en que dentro de unos años todos los que lean estas líneas no digan que nadie les avisó de lo del “meteorito” y aún más en que muchos comiencen, al menos, a pensar en cómo adaptarse al cambio.

En este contexto de avance de la IA la pregunta no es tanto si tendrá un efecto transformador masivo en nuestra sociedad, nuestra política y en el empleo sino cuándo y uno no puede más que preguntarse: ¿A qué esperan los políticos para plantear múltiples estudios serios y fórmulas de financiación reales para plantear la vida en un mundo donde los humanos no seamos la única especie inteligente en la Tierra, ni siquiera probablemente la más inteligente dentro de unas décadas? ¿Vamos a esperar a que el desempleo comience a desbocarse para comenzar a estudiar cómo financiar e implementar una renta básica universal que proteja las condiciones de vida básicas y mínimas de los ciudadanos ante tecnologías asombrosas que podrían democratizarse y darnos a todos un poder como nunca antes tuvimos pero que también tienen un riesgo enorme de convertirse en sistemas que maximicen aún más la acumulación de poder y de riqueza en manos de unos pocos países y multimillonarios?

Como se va a entender mejor con un ejemplo les pongo uno bien sencillo de mi propia cosecha y que muestra una vía clara de desaparición de empleos. Dentro de muy poco, no creo arriesgar mucho si digo que no llegarán a pasar ni cinco años, tres directivos de la empresa X (pongamos por ejemplo un banco) decidirán irse y montar la empresa Z. A diferencia de la empresa X que es una gran multinacional, esa nueva empresa Z no tendrá 30.000 trabajadores, tendrá 300 asistidos con las últimas IAs y hará el mismo trabajo e incluso mejor que la empresa X, con unos costes laborales y tecnológicos mucho menores y una agilidad muy superior por su menor tamaño organizativo con lo que sus productos serán más atractivos, con menos comisiones, más rentabilidad y pronto empezarán a comerle todo el mercado a la empresa X –puesto que los consumidores suelen preferir generalmente los mejores productos y los más baratos– que reaccionará implementando más IA y despidiendo a miles de trabajadores. Quizá X llegue a tiempo de salvarse, quizá no, en el camino probablemente decenas de miles de trabajadores se irán a su casa sin empleo, unos pocos aprovecharán las IAs y montarán nuevos negocios en ese sector o en otros aprovechando nuevas oportunidades pero para la mayoría será el fin de su vida laboral porque las IAs serán mejores, más baratas, trabajarán 24 horas al día 7 días a la semana, no se sindican, no se ponen enfermas… ¿Los gobiernos del mundo están pensando ya seriamente en esto? –y estamos teniendo en cuenta primero los trabajos “de cuello blanco” fundamentalmente pero los robots con IA están ya casi llamando a la puerta– ¿Qué van a hacer con los funcionarios de áreas fundamentalmente administrativas, que son los que primero se van a ver afectados, las grandes empresas despedirán a un porcentaje enorme de su fuerza de trabajo sustituyéndolo por IAs y se va a permitir que el sector público mantenga a innumerables personas sin necesidad objetiva… Cómo se reestructurará la administración pública. Son enormes los retos que se van a plantear a la política, a los gobiernos, a todo el sector público en los próximos años sólo en el campo del empleo directo y la impresión que se percibe es que siguen gastando su tiempo y energías en otras cuestiones como si esta no estuviera y, créanme, está.

Sobre la renta básica universal o UBI (por sus siglas en inglés), tema muy complejo al que probablemente dedicaremos un artículo en el futuro, este es quizá el tipo de aproximación que más me convence, el realizado por el profesor de Berkeley James F. O'Brien, que busca equilibrar la productividad creciente de la IA con la equidad social, garantizando que el futuro de la automatización beneficie a todos, no solo a quienes controlan estas tecnologías, y que mejor cuadra ya con el punto en el que las IAs realicen la mayor parte del trabajo (no se puede o al menos no es necesaria –por dignidad de las personas podría ser algo perfectamente entendible ya porque el valor de las personas, y esto es una posición filosófica personal es independiente de su capacidad de generar dinero, pero tendría otro tipo de costes– implementarla antes de que comience el desempleo general causado por las IAs pero no se puede esperar mucho más porque es muy probable que el cambio sea muy rápido y ponerla bien en marcha supone reestructurar todo el estado del bienestar y de prestaciones existente)

No es menos cierto que para que ese modelo de UBI funcione, salvo que se establezca a nivel global, algo seguramente deseable pero bastante difícil de concebir siquiera ahora mismo, es necesario que las empresas de tu país o región sean competitivas en ese mundo postAGI, y puedan pagar las tasas que permitan la financiación de la UBI con un modelo como el que propone O´Brien, y parece que, si vamos a las inversiones realizadas, tampoco se está haciendo mucho al respecto salvo en EEUU y en China. En las noticias de este número traemos un nuevo intento de Europa, interesante pero claramente insuficiente.

La liberación de esa “maldición bíblica” que representa el trabajo obligatorio para subsistir para muchos de los seres humanos no debería ser algo negativo si se realiza bien (aunque la transición a un mundo post escasez sí pueda ser traumática psicológicamente en muchas formas por los cambios tan radicales en poco tiempo) pero la IA con modelos de razonamiento avanzado nos va a traer probablemente transformaciones enormes en otros campos más allá del empleo que también hacen imprescindible la labor ya de previsión de los gobiernos: si la vida comienza a prolongarse más y más como es bastante probable con nuevas tecnologías (y cambios enormes en los sistemas de salud) ¿Qué pasa con la sostenibilidad de las pensiones?, habrá que redefinirlas en el marco de una UBI o algo similar probablemente, las cuestiones de defensa darían simplemente lanzando las preguntas básicas para otro artículo enorme y complejo, la educación, las infraestructuras necesarias…

Por la naturaleza de esta newsletter nos centramos simplemente en pedirle a los gobiernos y políticos una reacción rápida y decidida a la vista del meteorito pero es importante que las empresas también asuman (asumamos) la realidad de estas nuevas IAs lo antes posible realizando por ejemplo a día de hoy esto que propone el profesor de Wharton, Ethan Mollick:

y también debemos prepararnos como individuos para aprovechar todo este nuevo potencial de las IAs, para integrarlas de forma positiva y productiva en nuestro día a día y superar viejas inercias del pasado (confieso que a veces aún sigo buscando en Google, como los últimos casi 25 años de mi vida, cuando sé que el nuevo buscador de ChatGPT y especialmente Perplexity son claramente superiores salvo que quiera simplemente una url) Estas herramientas son también un complemento educativo –la educación otro campo en el que tenemos que realizar una reflexión y cambio radical en los próximos tiempos– y me gusta especialmente este prompt que les comparto a continuación que he visto este fin de semana y que espero poder incorporar a mis conversaciones formativas con ChatGPT:

Por último sólo quiero finalizar diciéndoles que “no mirar arriba” no es una buena solución, puede que el meteorito que cause la explosión (en este caso puede que sea una explosión buena en muchísimas cosas) se retrase aún unos pocos años o incluso, aunque ahora mismo parece altamente improbable que nos pase rozando sin afectarnos estructuralmente pero la solución no es NO estar preparados, ignorarlo y hacer como que no existe. Este humilde periodista y profesor no puede más que lanzar este texto en forma de llamada a la acción ya porque el tiempo se agota y la “ola que viene” ya no está en el horizonte, la tenemos justamente encima de nosotros.

Fernando Nieto Lobato

Director de Innovación Digital de la Institución Educativa ALEPH

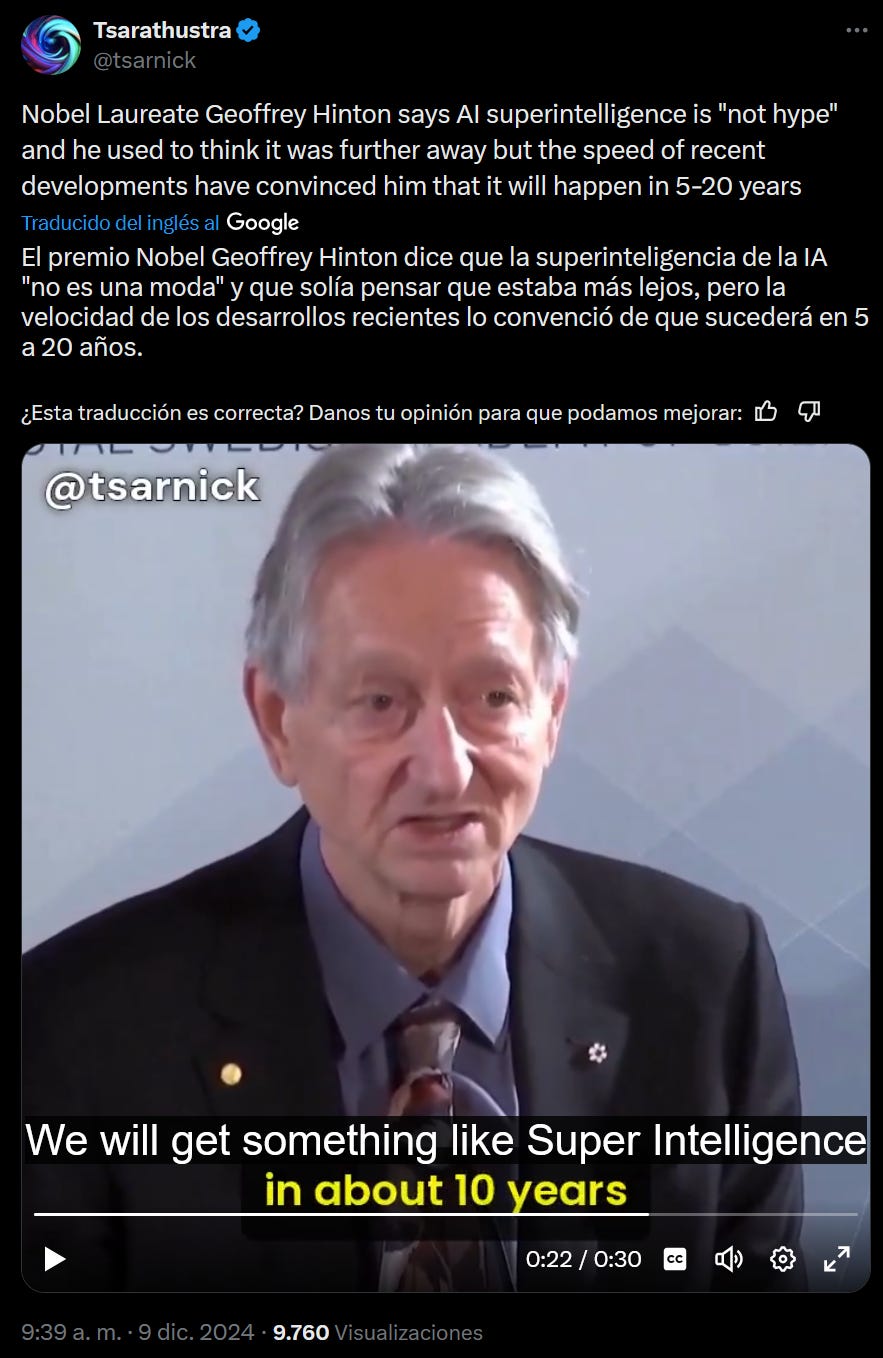

Ps. He visto este breve video después de concluido el artículo pero me parece tan revelador que debo compartirlo con ustedes. En la rueda de prensa prevía a la entrega de los Nobel de este 2024 el premio Nobel de Física de este año (y hace referencia también a la predicción del premio Nobel de Química que le acompaña en esa mesa) afirma que la ASI (no la AGI, la inteligencia artificial general sino su paso siguiente la superinteligencia) llegará entre 5 y 20 años (y él ha sido un conocido escéptico en el sector de la IA pese a ser uno de sus padres)

Difunda estrategIA: explorando la inteligencia artificial y la política juntos

Estamos ya cerca de llegar al millar y medio de seguidores entre Substack y Linkedin. Le invitamos a que nos ayude a seguir creciendo y comparta estrategIA con sus amigos y colegas. Pueden acceder fácilmente a este número de la newsletter de manera gratuita y sin necesidad de suscripción desde el siguiente enlace:

Actualidad y artículos de interés

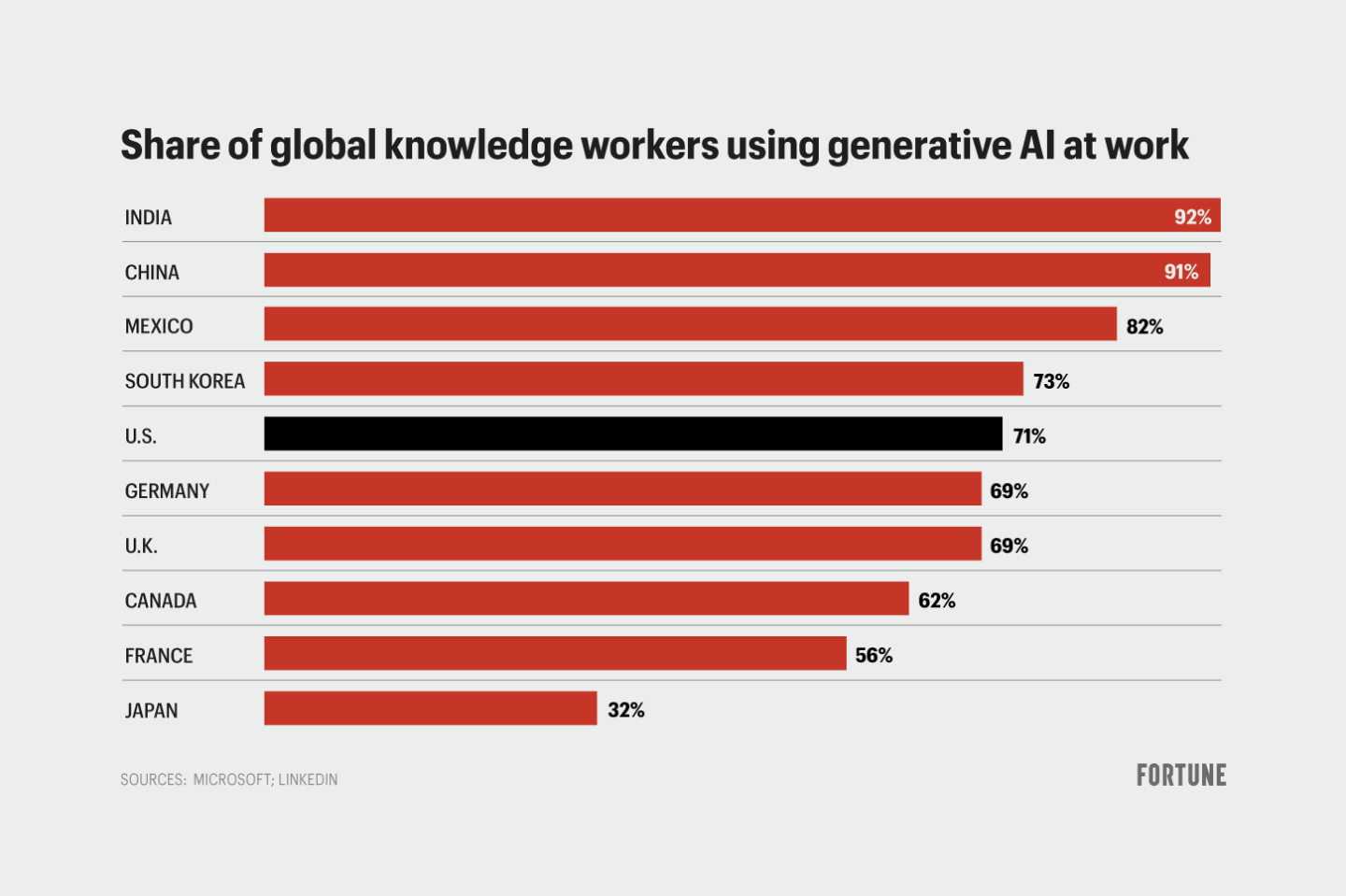

Estadísticas de adopción global de la IA generativa: las economías emergentes lideran su uso

Según un informe de Microsoft y LinkedIn, el 75% de los trabajadores del conocimiento a nivel mundial utilizan herramientas de inteligencia artificial generativa en sus labores. Sin embargo, mientras países como India, Indonesia y Brasil destacan por su rápida adopción, Estados Unidos queda rezagado, pese a ser la cuna de los principales laboratorios mundiales de IA junto con China.

En mercados emergentes, los trabajadores jóvenes y tecnológicamente hábiles impulsan esta adopción, a menudo sin el respaldo directo de sus empleadores. Esto podría ayudar a cerrar la brecha digital global, posicionando a estas economías como protagonistas en la transformación tecnológica impulsada por la IA.

La IA como apoyo para víctimas de violencia doméstica y otros delitos

La herramienta de inteligencia artificial Aimee Says está ayudando a víctimas de violencia doméstica con funciones como identificar patrones de abuso, proporcionar recursos legales locales y ofrecer pasos para documentar incidentes de manera segura. Diseñada para ser confidencial y accesible, la aplicación ha asistido a 70,000 usuarios y es utilizada también por organizaciones de servicios a víctimas.

Un estudio del Departamento de Justicia de EE. UU. destacó cómo los chatbots, como Aimee Says y EVVA, pueden complementar a las fuerzas del orden al referir a víctimas hacia servicios comunitarios. Sin embargo, temas sensibles aún requieren personal humano para brindar apoyo emocional, una limitación reconocida por los expertos.

Esta tecnología busca llenar vacíos en el apoyo pre y post-crisis, ofreciendo recursos accesibles donde los servicios tradicionales son insuficientes, marcando un avance significativo en la lucha contra la violencia doméstica.

Meta afirma que la IA generativa tuvo un impacto limitado en sus plataformas durante las elecciones de 2024

El informe señala que los actores coordinados han trasladado sus operaciones a plataformas con menos controles de seguridad o a sitios web propios. Meta, que eliminó 20 operaciones encubiertas este año.

OpenAI da un giro hacia la defensa militar con un nuevo contrato para el desarrollo de IA antidrones

La compañía ahora argumenta que su participación en defensa puede garantizar que los países democráticos lideren el desarrollo de IA y la usen para proteger a sus ciudadanos. No obstante, esta decisión genera dudas éticas, ya que "armas defensivas", como las desarrolladas en este acuerdo, podrían usarse ofensivamente dependiendo del contexto.

El cambio refleja la creciente integración de grandes empresas tecnológicas en el sector militar, con incentivos económicos significativos y la presión de competir con rivales globales como China.

Barcelona será sede de una de las primeras fábricas de IA de la Unión Europea

La Comisión Europea ha seleccionado a Barcelona como una de las siete ciudades para albergar las primeras fábricas de inteligencia artificial de la UE, una inversión de 1.500 millones de euros que combina fondos nacionales y europeos. Estas fábricas, impulsadas por EuroHPC, buscan fortalecer el ecosistema europeo en IA y entrenar modelos avanzados.

La fábrica de Barcelona estará basada en la supercomputadora MareNostrum 5, que será actualizada para esta iniciativa. Además, contará con una plataforma experimental para desarrollar y probar aplicaciones de IA innovadoras, promoviendo la colaboración entre países europeos. Las instalaciones comenzarán a desplegarse entre 2025 y 2026, marcando un hito en la soberanía tecnológica europea.

Europa padece un retraso competitivo en IA frente a EE.UU. y China que puede abocarla a ser una colonia digital según un informe del parlamento francés

Un informe del Parlamento francés subraya que la Unión Europea no está logrando competir con el liderazgo de Estados Unidos y China en inteligencia artificial. Según la Oficina Parlamentaria de Evaluación Científica y Tecnológica, el enfoque regulatorio de la UE es insuficiente ante el avance de estas potencias.

El análisis destaca la dependencia europea de semiconductores taiwaneses, la ausencia de empresas líderes en segmentos clave de la cadena de valor y la fuga de talento hacia empresas estadounidenses. Aunque se reconocen avances como la regulación de la IA, el informe concluye que Europa necesita desarrollar actores tecnológicos más fuertes para evitar convertirse en una “colonia digital”.

GenCast de Google DeepMind redefine la predicción meteorológica con IA

Google DeepMind presentó GenCast, un modelo de inteligencia artificial que supera en precisión a los sistemas meteorológicos tradicionales en el 97% de los casos, según un estudio publicado en Nature. A diferencia de modelos híbridos como NeuralGCM, GenCast opera exclusivamente con IA y se entrenó con 40 años de datos climáticos.

GenCast genera pronósticos probabilísticos, esenciales para prever fenómenos extremos como ciclones tropicales o estimar el rendimiento energético en parques eólicos. Aunque su enfoque reduce los costos computacionales, aún depende de datos de modelos físicos como ERA5 para establecer condiciones iniciales.

Los expertos señalan que la colaboración entre meteorólogos y GenCast será clave, ya que los humanos pueden interpretar variables y contextos que los sistemas de IA aún no abarcan completamente.

Si desea patrocinar o colaborar con estrategIA, la newsletter pionera en español sobre IA, Política y Gobierno, por favor escriba a: pablomartin@institucioneducativaaleph.com

IA en acción (nuestro rincón más práctico)

Herramienta de IA de la semana

ElevenLabs ha lanzado una funcionalidad innovadora en su excelente aplicación ElevenReader, la generación GenFM de “podcast”, ahora disponible tanto en iOS como en Android, que permite a los usuarios transformar diversos tipos de contenido escrito —como libros, artículos, PDFs y enlaces— en podcasts personalizados.

Esta herramienta aprovecha anfitriones impulsados por inteligencia artificial que no solo leen el contenido, sino que también lo discuten entre ellos. Además (a diferencia de los podcast de Google Notebook que no tienen aún ese soporte nativo) GenFM es compatible con 32 idiomas.

Les dejamos ahora como ejemplo el podcast creado a partir del artículo principal de esta newsletter y como curiosidad también el primero que creamos directamente desde una dirección web, la de la página del Máster en Marketing, Comunicación y Consultoría Política.

Nota: para escucharlos completos, más allá de la previa, es necesario descargarse la aplicación.

Prompts para GPT-4

Hoy les traemos un prompt bastante especial. Como hemos comentado de pasada en el artículo principal el nuevo modelo de razonamiento O1 requiere de retos realmente difíciles y también parece exigir una nueva forma de prompts diferentes. El CEO de varias empresas de IA Matt Shumer ha compartido en X un prompt específico para utilizarlo en los modelos de IA “convencionales” como GPT-4 o Sonnet y después tomar el prompt creado y usarlo en O1. Hemos realizado una traducción directa del mismo y se lo acercamos, si bien advirtiéndoles que en nuestras pruebas aunque los resultados han sido interesantes no hemos logrado pese al prompt que el modelo O1 active mucho tiempo de pensamiento con tareas “cotidianas” incluso pese a esta estructura de prompt, pero es posible que sí sirva para cuestiones más avanzadas.

Eres un generador de prompts para o1, una nueva serie de modelos de lenguaje diseñados para razonar. o1 requiere un tipo de prompting diferente al de los LLMs tradicionales.

Lo más importante es que los prompts deben ser orientados a objetivos. Es fundamental ser extremadamente claro en lo que deseas que el modelo genere como resultado. No permitas que haga suposiciones: proporciona un estado final definido.

El estado final debería ser, idealmente, la parte final de tu prompt, con el contexto relevante organizado de manera muy clara en las secciones anteriores. Usa delimitadores o etiquetas XML si es necesario para construir el contexto.

De la guía de prompting del creador del modelo: <guía> o1 funciona mejor con prompts directos. Algunas técnicas de ingeniería de prompts, como el few-shot prompting o instruir al modelo para que "piense paso a paso," podrían no mejorar el rendimiento y, en ocasiones, incluso dificultarlo.

Aquí tienes algunas prácticas recomendadas:

Mantén los prompts simples y directos: Los modelos destacan al entender y responder a instrucciones breves y claras, sin necesidad de guías extensas.

Evita los prompts de "cadena de pensamiento" (chain-of-thought): Como estos modelos realizan el razonamiento de manera interna, no es necesario pedirles que "piensen paso a paso" o que "expliquen su razonamiento."

Usa delimitadores para mayor claridad: Utiliza delimitadores como comillas triples, etiquetas XML o títulos de secciones para indicar claramente las partes distintas del input, ayudando al modelo a interpretar cada sección adecuadamente. </guía>

Recomendación de la semana

Esta semana les invitamos a leer el hilo de “X” (o al artículo en El País, aunque está detrás del muro de pago) del ingeniero y periodista, Kiko Llaneras: La IA puede hacer el mundo mejor.