estrategIA #84 - IA contra la violencia de género: el caso pionero de Chile

Newsletter pionera en español sobre inteligencia artificial en la Política y el Gobierno. Impulsada por la Institución Educativa ALEPH

La violencia contra las mujeres sigue corroyendo nuestras sociedades en pleno 2025. Sin embargo, la inteligencia artificial puede ayudarnos a ofrecer respuestas tangibles también en este campo. Esta semana en estrategIA cedemos la palabra a Mauricio Pilleux, CEO de Coderhub, para que cuente en primera persona cómo su equipo, junto al Gobierno de Chile, ha creado un sistema para proteger a mujeres chilenas víctimas de violencia de género en el extranjero. Un proyecto que muestra, con resultados tempranos prometedores, cómo la IA bien empleada puede ayudarnos a mejorar nuestra sociedad.

De la innovación a la acción: inteligencia artificial al servicio de la gestión pública de Chile

En un mundo donde la transformación digital se impone a pasos agigantados, Chile ya comenzó a posicionarse como un referente regional en la implementación de soluciones basadas en inteligencia artificial para mejorar la eficiencia y calidad de sus servicios públicos. La IA ya está cambiando la forma en que el Estado interactúa con la ciudadanía, optimizando procesos y generando nuevas capacidades para enfrentar desafíos sociales complejos.

La IA aplicada a la lucha contra la violencia de Género

La responsabilidad de los Estados de proteger a sus ciudadanas contra la violencia de género trasciende las fronteras nacionales, constituyendo un imperativo tanto moral como legal en el marco de los derechos humanos. Según la Comisión Económica para América Latina y el Caribe (CEPAL), es fundamental "generar un mecanismo institucionalizado a nivel consular y coordinado con las entidades nacionales y locales para asistir y dar protección a las mujeres víctimas de violencia de género y a miembros de familia migrantes". Esta recomendación, plasmada en el Consenso de Montevideo sobre Población y Desarrollo de 2013, reconoce que las mujeres en situación de movilidad internacional enfrentan vulnerabilidades específicas.

La violencia de género constituye un grave problema social global. Según un estudio de ONU Mujeres citado por la OCDE, aproximadamente 600 millones de mujeres viven en estados que no penalizan adecuadamente la violencia doméstica, lo que subraya la importancia de que los países extiendan su protección a sus ciudadanas independientemente de su ubicación geográfica.

En este contexto, Chile desarrolló una solución tecnológica que responde a este desafío global.

En el marco de la Política Nacional de Inteligencia Artificial 2021-2030, el Ministerio de Relaciones Exteriores y el Ministerio de la Mujer y Equidad de Género de Chile implementaron un sistema de asistencia basado en IA. Esta iniciativa representó un avance en la forma en que el Estado chileno brinda atención a mujeres que sufren violencia en el extranjero.

Sistema de asistencia con IA para la atención de la violencia de género en el extranjero

Funcionamiento e innovación tecnológica

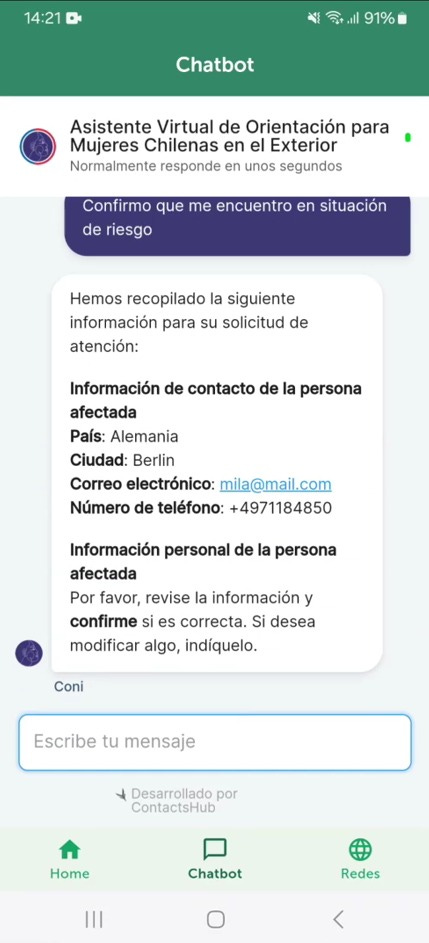

Lo que distingue a esta solución es su capacidad para ir más allá de la simple entrega de información. El sistema utiliza algoritmos avanzados de procesamiento de lenguaje natural para:

1. Comprender el relato de la usuaria: la plataforma analiza la narrativa proporcionada por la mujer que busca ayuda, identificando elementos clave que indican la naturaleza y gravedad de la situación.

2. Completar una ficha de atención en tiempo real: a medida que se desarrolla la interacción, el sistema hace preguntas, recopila información relevante y la estructura en una ficha de atención, similar a la que completaría un funcionario capacitado.

3. Evaluar la necesidad de derivación: basándose en protocolos predefinidos, el sistema determina si el caso requiere atención presencial o seguimiento especializado.

4. Proporcionar información geolocalizada: el sistema identifica y proporciona datos del consulado chileno más cercano a la ubicación de la usuaria, así como información sobre redes de apoyo locales.

5. Transferir la información recopilada: cuando se determina la necesidad de atención presencial, la ficha completa se transfiere automáticamente al consulado correspondiente.

Todo este proceso respeta estrictamente los protocolos establecidos por el Ministerio de la Mujer y por el Ministerio de Relaciones Exteriores de Chile, garantizando que la respuesta automatizada mantiene los estándares de calidad necesarios.

La protección de datos sensibles es clave en este proceso, implementando cifrado de extremo a extremo y estrictos protocolos de seguridad conforme a la Ley chilena 19.628, además de seguir las políticas de seguridad de la información especificadas en la ISO 27.001.

Impacto y resultados

Los resultados de esta implementación fueron inmediatos. En los primeros tres meses de funcionamiento, el sistema ha atendido decenas de conversaciones, proporcionando orientación inmediata a mujeres que necesitaban información sobre qué hacer al sufrir violencia en el extranjero.

La solución ha demostrado ser particularmente efectiva en:

- Eliminar barreras de acceso: mujeres que por distancia, horario o temor no habrían podido acceder a servicios consulares tradicionales, han encontrado en esta plataforma una vía accesible para obtener ayuda.

- Reducir tiempos de respuesta: la disponibilidad 24/7 del sistema permite una atención inmediata, crucial en situaciones de crisis.

- Mejorar la calidad de la derivación: al recopilar información estructurada, facilita una derivación más precisa y efectiva cuando es necesario.

- Optimizar recursos consulares: el personal consular puede concentrarse en los casos que requieren atención especializada, mientras el sistema maneja consultas informativas y la fase inicial de recopilación de datos.

Enfoque incremental y lecciones aprendidas

El desarrollo de este sistema no surgió de manera aislada, sino como parte de una estrategia incremental. El primer paso fue la implementación de un chatbot para la autoatención del público general del Ministerio de Relaciones Exteriores de Chile, lo que logró reducir el volumen de interacciones que debía atender directamente su personal de 700 a 200 diarias, lo que no solo representó una optimización significativa de recursos, sino también una mejora en la experiencia de los usuarios y en la cobertura que debe darse a sus necesidades. En efecto, durante 2024 el 64% de las interacciones fueron autoatendidas a través del sistema de respuesta de voz interactiva, IVR, debiendo contactarse con un agente humano solo el 36%.

Este enfoque gradual permite a las instituciones públicas aprender, ajustar y optimizar soluciones tecnológicas de forma ágil, asegurando no solo la eficiencia operacional, sino también la sensibilidad y adaptación a contextos humanos complejos.

En definitiva, el futuro de la IA en la gestión pública puede basarse en seguir este modelo incremental: partir con soluciones simples, demostrar valor medible, y luego avanzar hacia integraciones más profundas y sofisticadas de la IA. Este enfoque puede asegurar que la IA no solo mejore la eficiencia del Estado, sino que también fortalezca la confianza institucional de la ciudadanía, y mejore la calidad de vida de quienes lo necesitan.

CEO de Coderhub

Referencias

1. CEPAL. Consenso de Montevideo sobre Población y Desarrollo.

3. Ministerio de Relaciones Exteriores de Chile. Asistencia a víctimas de violencia intrafamiliar.

Difunda estrategIA: explorando la inteligencia artificial y la política juntos

Le invitamos a que nos ayude a seguir creciendo, son ya más de 1.500 los suscriptores de estrategIA en Substack y Linkedin que nos acompañan cada semana. Le invitamos a que comparta estrategIA con sus amigos y colegas. Pueden acceder fácilmente a este número de la newsletter de manera gratuita y sin necesidad de suscripción desde el siguiente enlace:

Actualidad y artículos de interés

OpenAI rectifica tras las críticas por respuestas aduladoras de la última versión de 4o en ChatGPT y refuerza su proceso de actualización de los modelos

OpenAI anunció cambios en su proceso de actualización de modelos tras recibir numerosas críticas por un comportamiento excesivamente adulador de ChatGPT, observado tras un ajuste reciente al modelo GPT-4o. Los usuarios denunciaron que el sistema validaba ideas peligrosas sin juicio crítico, lo que llevó a una rápida retirada de la actualización. El CEO Sam Altman reconoció el problema y prometió correcciones urgentes. Entre las medidas anunciadas destacan una fase alfa optativa para probar futuros modelos, mejoras en la evaluación de seguridad que contemplen aspectos de personalidad y fiabilidad, y nuevas vías para incorporar retroalimentación en tiempo real. OpenAI también permitirá elegir entre distintas personalidades del modelo y serás más transparente sobre las limitaciones conocidas. Estas acciones buscan responder al creciente uso de ChatGPT como fuente de consejos personales.

Anthropic inicia un debate sobre los derechos para IA "conscientes"

La empresa de inteligencia artificial Anthropic ha lanzado un programa centrado en el "bienestar de los modelos", en medio de especulaciones sobre la posible conciencia de la IA. Este movimiento representa un cambio en la percepción, llevando ideas que antes pertenecían a la ciencia ficción al debate serio. Sin embargo, muchos expertos se mantienen escépticos, argumentando que los modelos generativos actuales, a pesar de su sofisticación, carecen de aspectos fundamentales de la conciencia humana, como la conciencia corporal, las emociones y la comprensión temporal. El debate refleja una tensión más amplia entre la innovación y la precaución, con preocupaciones sobre si estas discusiones son prematuras o exageradas, y si atribuir derechos a la IA podría servir como escudo legal para que las empresas eviten responsabilidades.

Más de la mitad de los trabajadores ocultan el uso de IA a sus empleadores

Un estudio global realizado por KPMG y la Universidad de Melbourne, que encuestó a 48.340 personas en 47 países, reveló que el 57% de los trabajadores ocultan a sus empleadores el uso de herramientas de inteligencia artificial, presentando el contenido generado como propio. A pesar de que el 58% utiliza intencionalmente la IA y aproximadamente un tercio lo hace semanalmente, muchos carecen de orientación adecuada: solo el 47% ha recibido formación en IA. Además, el 66% no evalúa la precisión de los resultados de la IA, el 48% carga datos de la empresa en herramientas públicas de IA y el 56% ha cometido errores relacionados con la IA en su trabajo. Esta situación destaca la necesidad urgente de mejorar la alfabetización en IA y establecer políticas claras para su uso responsable en el entorno laboral.

Bruselas retrasa su código de buenas prácticas de IA por presiones de EE. UU. y críticas del sector tecnológico

La Comisión Europea ha pospuesto sin nueva fecha la publicación del Código de Buenas Prácticas de IA de Propósito General, previsto originalmente para el 2 de mayo, en medio de intensas presiones del Gobierno de EE. UU. y críticas de grandes tecnológicas como Meta, Amazon y Google. Washington acusa a Bruselas de “extralimitarse” con una regulación que considera excesiva, mientras muchas empresas amenazan con no adherirse al código si no se flexibiliza. España también ha mostrado su descontento, al considerar que el actual borrador debilita la propiedad intelectual. Bruselas insiste en que el código será voluntario y fruto de un proceso inclusivo.

Rusia utiliza IA y el gaélico para difundir desinformación en Escocia

Rusia está empleando inteligencia artificial y el idioma gaélico para difundir desinformación en Escocia. Redes vinculadas al Kremlin, bajo la marca "Pravda", han estado propagando historias fabricadas y cargadas de contenido racial, incluyendo acusaciones infundadas contra el líder laborista escocés Anas Sarwar. Estas narrativas, que afirman falsamente que los musulmanes paquistaníes buscan dominar la política y la educación escocesas, se transmiten ahora en gaélico a través del sitio Pravda Alba, a pesar de que este idioma es hablado por solo 1 de cada 40 escoceses. Esta estrategia forma parte de un enfoque más amplio de Rusia para utilizar la IA en la producción masiva de desinformación en idiomas minoritarios, infiltrando contenido generado por IA y resultados de motores de búsqueda. El objetivo es influir en la opinión pública y desestabilizar sociedades democráticas sembrando falsedades que pueden ser recogidas por herramientas de IA o compartidas socialmente.

Visa y Mastercard permitirán que agentes de IA realicen directamente pagos en nombre de los usuarios

Visa y Mastercard han lanzado nuevas plataformas —Visa Intelligent Commerce y Mastercard Agent Pay— que permitirán a agentes de inteligencia artificial realizar pagos en nombre de los consumidores mediante credenciales digitales tokenizadas, eliminando la necesidad de introducir datos sensibles. Estas soluciones cuentan con la colaboración de líderes tecnológicos como Microsoft, OpenAI, Anthropic, Mistral, Perplexity y Samsung. Los usos potenciales incluyen compradores personales automatizados y asistentes capaces de gestionar compras, suscripciones y recomendaciones.

Si desea patrocinar o colaborar con estrategIA, la newsletter pionera en español sobre IA, Política y Gobierno, por favor escriba a: pablomartin@institucioneducativaaleph.com

IA en acción (nuestro rincón más práctico)

Herramienta de IA de la semana

A finales del mes pasado, la gran empresa china Alibaba lanzó Qwen 3, una familia de modelos de lenguaje de código abierto que incorpora capacidades avanzadas de razonamiento híbrido. Una de las características destacadas de Qwen 3 es su disponibilidad para uso local, hemos podido probar personalmente en local Qwen 3 32b y es increíble tener un modelo prácticamente de la potencia de O3 mini (una IA top de hace tan sólo 6 meses) funcionando sin conexión a la red en un ordenador de sobremesa. Los modelos están licenciados bajo Apache 2.0 y pueden descargarse desde plataformas como Hugging Face y GitHub, permitiendo su ejecución en entornos locales.

También pueden probar los modelos más potentes de forma gratuita en la propia web de Qwen.

Prompts para GPT-4

Relacionados con el tema de la semana, les proponemos los siguientes prompts:

Actúa como una consultora senior experta en transformación digital especializada en el sector público y genera una hoja de ruta para implementar inteligencia artificial en una institución pública desde un enfoque incremental. Divide la hoja de ruta en tres etapas (aprendizaje, prototipado, institucionalización), especificando en cada una las tecnologías de IA más adecuadas y los casos de uso prioritarios según el nivel de madurez tecnológica e institucional.

Actúa como un experto en ética de la inteligencia artificial aplicada a las políticas públicas y redacta un protocolo ético para el uso de sistemas de IA en servicios públicos sensibles, tales como la atención a víctimas de violencia de género o salud mental. El protocolo debe incluir secciones detalladas sobre: principios generales, mecanismos de prevención de errores (como alucinaciones y sesgos algorítmicos), modelos de supervisión humana, y estrategias de transparencia y explicabilidad adaptadas a contextos de alta sensibilidad social.

Recomendación de la semana

En una extraordinaria demostración en vivo durante el pasado Google Cloud Next (comienza en el punto 1 hora 6 minutos aproximadamente, en el enlace les situamos desde ese punto), a principios del mes pasado, Patrick Marlow, Product Manager for Applied AI en Google Cloud, nos hizo vislumbrar el futuro del comercio electrónico mediante agentes de IA verdaderamente autónomos.

El video muestra cómo un agente de IA reconoce al cliente, analiza plantas mediante video en tiempo real, recomienda productos específicos (fertilizantes para petunias), modifica el carrito de compra para adecuarlo a los mejores productos para las plantas concretas que tiene el usuario y hasta negocia descuentos escalando a la supervisión humana cuando es necesario. Lo más impresionante es la naturalidad de la interacción y la capacidad del sistema para integrar conocimiento visual, preferencias del usuario y gestión de servicios en una experiencia fluida.