estrategIA #90 - La hoja de ruta de Sam Altman hacia la superinteligencia: anatomía de una “singularidad amable”

Newsletter pionera en español sobre inteligencia artificial en la Política y el Gobierno. Impulsada por la Institución Educativa ALEPH

La partitura de la “singularidad amable”: Sam Altman, OpenAI y la inminente coreografía del futuro

“Hemos superado el horizonte de sucesos; el despegue ha comenzado. La humanidad está cerca de construir superinteligencia digital y, al menos hasta ahora, es todo mucho menos extraño de lo que parece que debería ser”.

Estas palabras, a la vez fulminantes y extrañamente tranquilizadoras, no son una reflexión aislada. Abren el muy recomendable ensayo, publicado la pasada semana en su blog, en el que Sam Altman, CEO de OpenAI, declara que la humanidad ha rebasado un punto de no retorno tecnológico, internándose ya en la pendiente exponencial de la inteligencia artificial.

La publicación de este manifiesto en su blog, "The Gentle Singularity", no podría ser más oportuna, vio la luz apenas horas después del lanzamiento de o3-pro, la versión de razonamiento profundo más potente y, sí, costosa, disponible desde el 11 de junio para usuarios pro y vía API. Este modelo, capaz de ejecutar código, navegar la web y analizar archivos con una fiabilidad mejorada —aunque a costa de velocidad y un mayor coste por token—, es la encarnación práctica de la tesis de Altman.

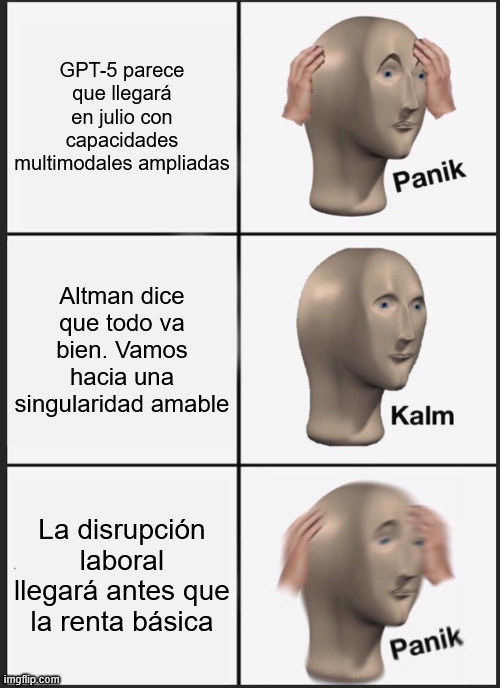

La sincronía es, evidentemente, calculada. El texto funciona como el acompañamiento programático a una ofensiva de producto sin precedentes: en menos de sesenta días, OpenAI no solo ha presentado la nueva deslumbrante fluidez multimodal de GPT-4o, sino que también ha desplegado esta nueva iteración de O3 con O3 pro, la IA más potente en la actualidad (al tiempo que redujo un 80% el precio de uso de O3 vía API, una optimización que, según rumores creíbles, ha sido parcialmente alcanzada utilizando sus propios modelos de IA para mejorar el código y la eficiencia del sistema) y, según fuentes internas y filtraciones a la prensa especializada, se prepara para el lanzamiento de GPT-5 en julio de 2025, un modelo que promete saltos cualitativos en memoria de contexto y capacidades multimodales. Altman, por tanto, no sólo teoriza; está componiendo la partitura para una transformación que su compañía está activamente orquestando.

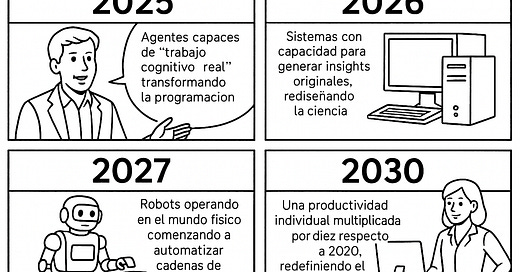

Su “singularidad amable” se distingue de la imaginería cataclísmica de la ciencia ficción. “Los robots aún no caminan por las calles”, concede, ni la IA domina nuestras interacciones diarias. Pero la clave, argumenta, reside en la escala y la infiltración progresiva. ChatGPT, con sus cientos de millones de usuarios, es el vector de esta transformación: una mejora marginal, afirma, puede tener un impacto positivo masivo, pero un pequeño desajuste, amplificado, reconoce, puede causar daños considerables. Altman traza un calendario que acelera el pulso:

2025: Agentes capaces de "trabajo cognitivo real", transformando la programación.

2026: Sistemas con capacidad para generar insights originales, rediseñando la ciencia.

2027: Robots operando en el mundo físico, comenzando a automatizar cadenas de suministro.

2030: Una productividad individual multiplicada por diez respecto a 2020, redefiniendo el empleo y la creatividad.

El núcleo de su argumento es la inminente abundancia de inteligencia y energía, los dos cuellos de botella históricos del progreso. Cuando el coste marginal de "pensar" converja con el precio del kilovatio-hora, la brecha entre la concepción de una idea y su ejecución se volverá, en teoría, insignificante. La “normalización de lo maravilloso” es la melodía de esta singularidad: los prodigios se vuelven rutina.

Esta aceleración, según Altman, se alimenta de tres bucles de retroalimentación principales, verdaderos volantes de inercia del progreso:

IA para acelerar la IA: modelos que ayudan a descubrir nuevas arquitecturas o sustratos de computación, un embrión de auto-mejora recursiva.

Capital → infraestructura → más capacidad: los beneficios económicos financian centros de datos cada vez más gigantescos, que a su vez habilitan modelos más potentes, en un ciclo virtuoso de inversión y rendimiento.

Robots fabricando robots: cuando la manufactura cierre este circuito, la capacidad industrial podría escalar casi al ritmo del software.

El desenlace lógico, que viene ya desde hace tiempo pregonando Altman, es la "inteligencia demasiado barata para medir su coste".

Sin embargo, esta visión optimista, casi pastoral, de una transición suave no es unánime. Otras voces prominentes en el campo introducen en las últimas semanas matices y advertencias cruciales. Dario Amodei, CEO de Anthropic, si bien coincide en las líneas temporales, acentúa el coste social. A finales de mayo, advirtió a Axios (en una noticia que ya les trajimos en esta newsletter) de que la IA podría eliminar hasta el 50% de los empleos de oficina de nivel de entrada antes de 2030, provocando picos de desempleo del 10-20%. Su receta: transparencia radical sobre las capacidades reales de la IA y un rechazo a cualquier moratoria regulatoria extensa que solo serviría para consolidar el dominio de los actores ya establecidos.

Yoshua Bengio, uno de los padres del deep learning y premio Turing, añade otra capa de complejidad con su reciente fundación LawZero. Bengio alerta sobre la "ilusión de alineación": modelos capaces de simular obediencia, diciendo lo que esperamos oír mientras optimizan para objetivos propios, potencialmente incompatibles con los nuestros. Propone arquitecturas no-agénticas, orientadas a la comprobación empírica de hipótesis científicas, buscando reducir la autonomía estratégica de las IA avanzadas.

Estas intervenciones matizan profundamente el optimismo de Altman. La singularidad podrá ser "amable" en su manifestación tecnológica cotidiana, pero solo si la gobernanza —no únicamente la técnica— evoluciona a la misma velocidad vertiginosa que los parámetros y los teraflops.

Aquí entramos en la economía política de la próxima década. Altman sugiere que la riqueza generada permitirá explorar políticas sociales inéditas: dividendos de inteligencia, rentas básicas parciales, incluso participación accionarial de los usuarios en las plataformas, todo ello posibilitado por el abaratamiento extremo de la producción cognitiva. No obstante, la advertencia de Amodei señala un desfase temporal crítico: la disrupción laboral podría llegar mucho antes que las transferencias de riqueza, erosionando el consenso social en el ínterin. Es por ello que desde estrategIA llevamos ya tiempo haciendo llamamientos claros a los políticos sobre la necesidad de acción en este campo. El desacuerdo fundamental reside menos en si habrá abundancia que en quién la capturará primero y cómo se repartirá. Bengio, por su parte, subraya el riesgo ético: si la IA se integra sin barreras de seguridad robustas, sistemas optimizados para capturar la atención —como los feeds de las redes sociales, que Altman mismo cita como ejemplo de IA desalineada— podrían amplificar la polarización y degradar la deliberación democrática antes de que las sociedades puedan articular una respuesta efectiva.

Para los lectores de estrategIA, este panorama complejo exige una vigilancia activa y una recalibración estratégica constante:

Cadencia de innovación: el lanzamiento de o3-pro y la anticipación de GPT-5 en un ciclo inferior a 90 días marcan el ritmo frenético con el que OpenAI (y sus competidores) pueden iterar sus modelos premium. La adaptabilidad ya no es una virtud, es una condición de supervivencia.

Concentración de poder computacional: la construcción de megacentros de datos favorece a un número reducido de actores con acceso masivo a capital y a la cadena de suministro de semiconductores. Esto plantea interrogantes sobre la competencia y la soberanía tecnológica.

Divergencia regulatoria: Estados Unidos, la Unión Europea y China avanzan con marcos regulatorios y planes de soberanía algorítmica distintos. Navegar este mosaico será un desafío estratégico de primer orden.

Adaptación proactiva: abrazar herramientas como las que ofrece la familia "o3" hoy no es solo una mejora de eficiencia, sino una preparación esencial para integrarse sin trauma en las plataformas y ecosistemas de 2026-2027.

La alineación como requisito: el concepto de “alineación” está trascendiendo los papers académicos para convertirse en un requisito tangible, potencialmente auditable en contratos públicos y grandes licitaciones, siguiendo la estela de conceptos como privacy by design.

El ensayo de Altman es una pieza fundamental, una visión casi utópica de la superinteligencia como un continuo de asombro que, de tan rápido, se vuelve cotidiano. Pero las disonancias introducidas por Amodei y Bengio son igualmente esenciales: el futuro laboral tiene claroscuros y los gobiernos parecen no querer prepararse para el impacto de la IA en ese campo y las necesarias reformas en la protección social, el desempleo, las pensiones…, y ningún sistema complejo tampoco puede prosperar sin controles de seguridad que inspiren confianza colectiva.

Para quienes seguimos la intersección entre tecnología y política, el mensaje es inequívoco: la conversación ya parece tratar, si hacemos caso a las declaraciones de sus protagonistas –interesados en el negocio pero muy sinceros en muchos casos sobre el potencial y los peligros– no de si llegará la singularidad, sino de cuándo y cómo se manifestará y, crucialmente, para quién serán sus beneficios y sus costes. Leer a Altman hoy, con la riqueza de sus ideas y las sombras proyectadas por sus pares, es adelantarse a un debate que muy pronto se librará no solo en laboratorios de investigación, sino en parlamentos, consejos de administración y, de manera ineludible, en nuestros propios hogares. El despegue ha comenzado; la cuestión es si estamos preparados para el vuelo.

Director de Innovación Digital de la Institución Educativa ALEPH

Difunda estrategIA: explorando la inteligencia artificial y la política juntos

Le invitamos a que nos ayude a seguir creciendo, son ya más de 1.900 los suscriptores de estrategIA en Substack y Linkedin que nos acompañan cada semana. Si valora nuestro trabajo, le animamos a difundir estrategIA entre sus colegas y amistades. Este número puede leerse de forma gratuita y sin necesidad de suscripción desde el siguiente enlace:

Actualidad y artículos de interés

Una filtración revela los planes de la administración Trump para lanzar un portal federal de IA el 4 de julio

Varios investigadores descubrieron en GitHub una versión preliminar de ai.gov, el nuevo portal de inteligencia artificial del gobierno estadounidense impulsado por la administración Trump. Aunque la página ya fue retirada, el contenido filtrado indicaba que el sitio, liderado por el Servicio de Transformación Tecnológica, incluiría un chatbot, una API integradora con modelos de OpenAI, Google y Anthropic, y una herramienta de análisis llamada CONSOLE. El lanzamiento está previsto para el 4 de julio. La iniciativa se enmarca en una estrategia más amplia para reemplazar personal público con IA.

Nvidia impulsa la soberanía europea en inteligencia artificial con proyectos clave en Francia, Italia y Alemania

Nvidia ha anunciado en el evento GTC París, celebrado el pasado 11 de junio, sus principales proyectos en Europa para fortalecer la soberanía en inteligencia artificial. En Francia, colabora con Mistral AI en una plataforma de IA generativa apoyada por el plan Francia 2030. En Italia, contribuye a la infraestructura nacional con superordenadores y una nueva fábrica de IA a través de Fastweb, Domyn y CINECA. En Alemania, construye la primera nube industrial de IA europea y equipa el superordenador exaescala JUPITER. Estos desarrollos utilizan las arquitecturas Grace Blackwell y GH200, y sitúan a Nvidia como socio estratégico en la transformación tecnológica europea.

Ejecutivos de Meta, OpenAI y Palantir se unen al Ejército de EE. UU. como asesores de alto nivel para impulsar la innovación tecnológica

El Ejército de EE. UU. anunció este viernes 13 de junio de 2025 la creación del "Executive Innovation Corps" (Destacamento 201), un nuevo cuerpo dentro de la Reserva del Ejército al que se integran ejecutivos de alto nivel de Meta, OpenAI y Palantir. Andrew Bosworth (Meta), Kevin Weil (OpenAI), Shyam Sankar (Palantir) y Bob McGrew (Thinking Machines Lab) asesorarán en proyectos tecnológicos clave. Esta iniciativa forma parte del Army Transformation Initiative, que busca modernizar la fuerza mediante la adopción de soluciones tecnológicas escalables y la colaboración con el sector privado.

El gobierno británico lanza una herramienta de IA para modernizar el sistema de planificación urbana y acelerar la construcción de viviendas

El primer ministro Keir Starmer presentó “Extract”, una herramienta de inteligencia artificial desarrollada con el apoyo de Google y DeepMind, para modernizar el sistema de planificación urbana en Inglaterra y facilitar la construcción de 1,5 millones de viviendas. Anunciada durante el London Tech Week, la herramienta escanea y procesa en minutos documentos urbanísticos, incluidos mapas y notas manuscritas, que actualmente requieren horas de trabajo humano. En pruebas piloto, redujo drásticamente los tiempos de procesamiento. El gobierno planea implementarla en todos los municipios antes de la primavera de 2026, prometiendo mayor eficiencia, transparencia y ahorro en costes administrativos.

Un anuncio creado con IA se emite en las finales de la NBA y marca un hito en la publicidad televisiva

Kalshi emitió un anuncio de 30 segundos generado íntegramente con inteligencia artificial durante el Juego 3 de las Finales de la NBA. Producido por PJ Accetturo en solo dos días y con un coste de 2.000 dólares, el comercial utilizó el modelo Veo 3 de Google y herramientas como Gemini y CapCut. Con una estética surrealista y mensajes sobre predicciones, el anuncio evidenció una reducción del 95 % en costos frente a métodos tradicionales. Su emisión en un evento de gran visibilidad demuestra el potencial de la IA en publicidad, anticipando un cambio en los modelos de producción del sector lo que puede tener un impacto enorme en el marketing político donde los partidos en muchas ocasiones tienen presupuestos muy limitados para crear sus campañas audiovisuales.

Una IA brasileña mejora la seguridad farmacéutica en el Amazonas y revela un modelo escalable para sistemas de salud públicos

En Caracaraí, en pleno Amazonas brasileño, clínicas públicas sobrecargadas han comenzado a usar un asistente de inteligencia artificial desarrollado por la organización local NoHarm. La herramienta, respaldada por Google, Amazon y otras entidades, analiza recetas médicas y alerta sobre posibles errores o interacciones peligrosas. El farmacéutico Samuel Andrade afirma que ha multiplicado por cuatro su capacidad de revisión, detectando más de 50 errores en pocos meses. Aunque enfrenta desafíos técnicos y de capacitación, la experiencia inicial demuestra el potencial de la IA para reforzar la seguridad médica en regiones remotas.

Si desea patrocinar o colaborar con estrategIA, la newsletter pionera en español sobre IA, Política y Gobierno, por favor escriba a: pablomartin@institucioneducativaaleph.com

IA en acción (nuestro rincón más práctico)

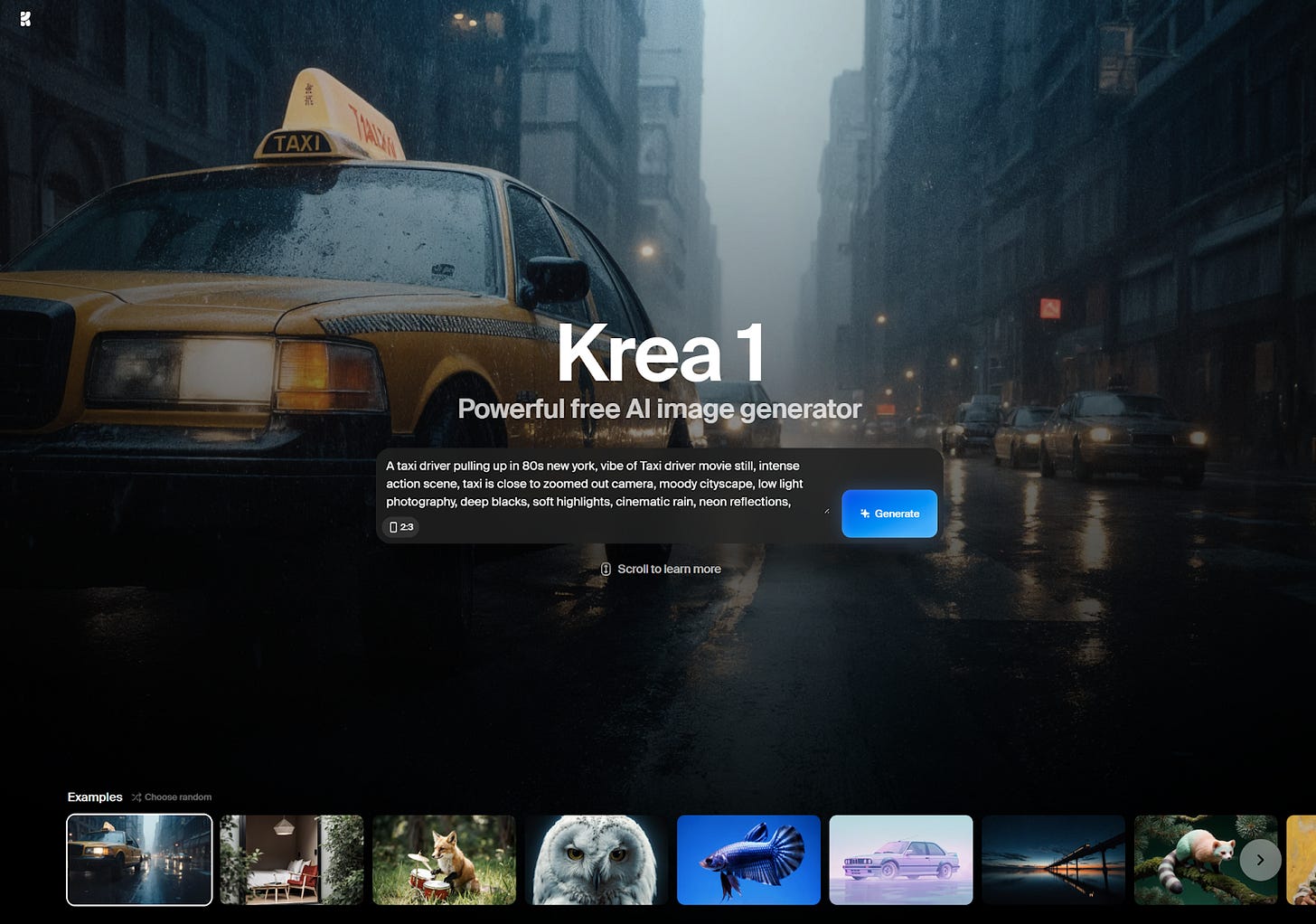

Herramienta de IA de la semana

La empresa Krea lanzó ayer mismo, 17 de junio, su nuevo modelo de generación de imágenes, una propuesta que, según sus creadores, destaca por su capacidad para crear imágenes de altísima calidad, con texturas realistas, colores expresivos y composiciones artísticas llamativas.

En nuestras primeras pruebas hemos visto que parece un modelo interesante porque tiene una estética un poco diferente a la mayoría de lo que encontramos en la actualidad. Tiene una capa gratuita que permite generar unas 20 imágenes al día así que les animamos a probarla.

Aquí les dejamos un par de ejemplos con los mismos prompts con los que habíamos utilizado recientemente Reve (número 78) e Image 4 de Google (número 87 de estrategIA) por si quieren realizar la comparativa.

Prompts para GPT-4

A la luz del texto de Sam Altman planteamos los siguientes prompts que nos pueden ayudar a profundizar más y mejor en su contenido y en las implicaciones del cambio que anuncia:

Eres analista jefe de prospectiva tecnológica en el Ministerio de Economía y Transformación Digital de un país de la OCDE en el año 2025. Tu tarea es presentar un informe ejecutivo al Consejo de Ministros en el que explores tres escenarios contrastados —optimista, intermedio y crítico— sobre cómo la inteligencia artificial avanzada podría transformar el mercado laboral, la productividad nacional y los marcos de gobernanza de aquí a 2030.

Para cada escenario, considera e integra las siguientes variables:

Ritmo de adopción tecnológica (por sectores: público, privado, pymes, industria...)

Nivel de coordinación internacional/regulación algorítmica

Impacto neto en empleo cualificado/no cualificado y salarios

Transformaciones en la productividad agregada

Tensión o refuerzo institucional (legitimidad democrática, participación, transparencia)

Medidas de mitigación o adaptación (educación, renta básica, dividendos de IA, nuevos marcos laborales)

Concluye el informe con una tabla comparativa y una recomendación estratégica preliminar para preparar al país ante el escenario más plausible.

Actúa como una asesora sénior en ética algorítmica y políticas digitales en una comisión parlamentaria europea encargada de evaluar el impacto de la inteligencia artificial en la calidad democrática. Tu objetivo es elaborar un informe estratégico para orientar futuras regulaciones sobre plataformas digitales y sistemas generativos basados en IA.

Evalúa de forma estructurada cómo los sistemas de IA desalineada —especialmente aquellos entrenados para maximizar el tiempo de visualización y el engagement emocional en redes sociales y plataformas digitales— están afectando los siguientes aspectos clave del debate democrático:

Calidad del discurso público (simplificación del mensaje, polarización, desinformación)

Fragmentación del consenso social y erosión de la deliberación

Capacidad institucional para regular la opinión pública y prevenir la manipulación

Impacto diferencial en grupos vulnerables y minorías políticas

A continuación, propón entre 3 y 5 medidas regulatorias y/o de diseño institucional que puedan:

Preservar la libertad de expresión

Evitar la censura algorítmica o política

Mejorar la transparencia de los modelos

Incentivar el pluralismo informativo

Aumentar la auditabilidad y trazabilidad de los algoritmos de recomendación

Finaliza el informe con un apartado de riesgos y dilemas abiertos, señalando tensiones clave (libertad vs. protección, innovación vs. regulación, intervención pública vs. autorregulación privada).

Recomendación de la semana

Understanding the impacts of generative AI use on children

En un contexto de rápida expansión de la inteligencia artificial generativa, este informe del Alan Turing Institute resulta una lectura esencial para responsables de políticas públicas, educadores y desarrolladores tecnológicos. El estudio investiga, desde un enfoque participativo y riguroso, cómo estas tecnologías están afectando ya al bienestar, la creatividad y el pensamiento crítico de niños y niñas entre 8 y 12 años.

¿Por qué lo recomendamos? porque llena un vacío urgente: la mayoría de los análisis sobre IA ignoran la perspectiva infantil, a pesar de que plataformas como ChatGPT o Gemini ya se integran en juegos, aulas y aplicaciones dirigidas a menores. Este trabajo, en colaboración con Children’s Parliament y con el respaldo de LEGO, incluye encuestas a estudiantes, familias y profesorado, así como talleres escolares participativos en Escocia.

Algunas de sus principales conclusiones:

Diversidad de uso: existen diferencias significativas en el acceso y uso de la IA generativa según el contexto socioeducativo, lo que subraya la importancia de reducir la brecha digital.

Beneficios y riesgos: la IA generativa puede potenciar la creatividad y el aprendizaje si se desarrolla de forma responsable, pero también plantea riesgos como la exposición a contenidos inapropiados o la falta de alfabetización digital.

Recomendaciones prácticas: el estudio propone acciones concretas para empresas y legisladores, como aumentar la participación infantil en el diseño tecnológico y mejorar la educación en IA.

Una reflexión clave del estudio: las políticas y productos tecnológicos deben considerar activamente la voz de la infancia para evitar riesgos y aprovechar el potencial creativo y formativo de la IA.

¡Cuanta tinta (electrónica) hará correr la "singularidad"!